Die vorliegende Übersetzung wurde maschinell erstellt. Im Falle eines Konflikts oder eines Widerspruchs zwischen dieser übersetzten Fassung und der englischen Fassung (einschließlich infolge von Verzögerungen bei der Übersetzung) ist die englische Fassung maßgeblich.

Erhalten Sie sofort potenzielle Instances

Inference Recommender kann Ihnen auf der Detailseite Ihres SageMaker KI-Modells auch eine Liste potenzieller Instances oder Instance-Typen, die für Ihr Modell geeignet sein könnten, zur Verfügung stellen. Inference Recommender führt automatisch ein vorläufiges Benchmarking mit Ihrem Modell durch, sodass Sie die fünf potenziellen Instances mit den besten Ergebnissen ermitteln können. Da es sich dabei um vorläufige Empfehlungen handelt, empfehlen wir Ihnen, weitere Instance-Empfehlungsaufträge auszuführen, um genauere Ergebnisse zu erhalten.

Sie können eine Liste potenzieller Instanzen für Ihr Modell entweder programmgesteuert mithilfe der DescribeModelAPI, des SageMaker Python-SDK oder der SageMaker AI-Konsole anzeigen.

Anmerkung

Sie erhalten keine potenziellen Instanzen für Modelle, die Sie in SageMaker KI erstellt haben, bevor diese Funktion verfügbar wurde.

Führen Sie die folgenden Schritte aus, um die potenziellen Instances für Ihr Modell über die Konsole anzuzeigen:

-

Gehen Sie zur SageMaker Konsole unter https://console.aws.amazon.com/sagemaker/

. -

Wählen Sie im linken Navigationsbereich die Option Inferenz und anschließend die Option Modelle.

-

Wählen Sie Ihr Modell aus der Modellliste aus.

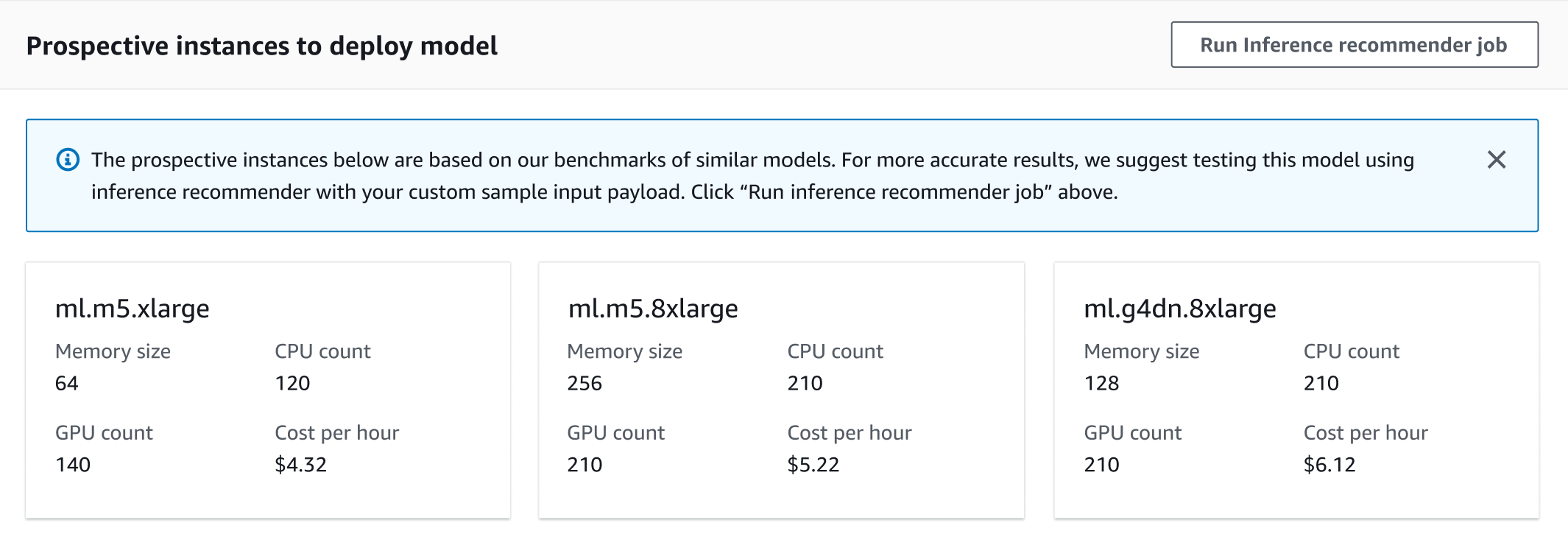

Gehen Sie auf der Detailseite für Ihr Modell zum Abschnitt Voraussichtliche Instances für das Einsatzmodell. Der folgende Screenshot zeigt diesen Abschnitt.

In diesem Abschnitt können Sie sich die potenziellen Instances ansehen, die im Hinblick auf Kosten, Durchsatz und Latenz für die Modellbereitstellung optimiert sind, sowie zusätzliche Informationen für jeden Instance-Typ wie Speichergröße, CPU- und GPU-Anzahl und Kosten pro Stunde.

Wenn Sie sich entscheiden, eine Beispiel-Payload zu vergleichen und einen vollständigen Job für Inferenzempfehlungen für Ihr Modell auszuführen, können Sie auf dieser Seite einen Standard-Job für Inferenzempfehlungen starten. So starten Sie einen Standardauftrag über die Konsole:

-

Wählen Sie auf der Seite mit den Modelldetails im Abschnitt Voraussichtliche Instances für das Einsatzmodell die Option Inferenz-Empfehlungsauftrag ausführen aus.

-

Geben Sie in dem daraufhin angezeigten Dialogfeld für S3-Bucket für Benchmarking-Nutzdaten, den Amazon S3-Speicherort ein, an dem Sie eine Beispiel-Payload für Ihr Modell gespeichert haben.

-

Geben Sie als Payload-Inhaltstyp die MIME-Typen für Ihre Payload-Daten ein.

-

(Optional) Geben Sie im Abschnitt Modellkompilierung mit SageMaker Neo für die Dateneingabekonfiguration eine Datenform im Wörterbuchformat ein.

-

Wählen Sie Auftrag ausführen aus.

Inference Recommender startet den Job, und Sie können den Job und seine Ergebnisse auf der Seite mit der Liste der Inference-Empfehlungen in der AI-Konsole anzeigen. SageMaker

Wenn Sie einen erweiterten Job ausführen und benutzerdefinierte Lasttests durchführen oder zusätzliche Einstellungen und Parameter für Ihren Job konfigurieren möchten, finden Sie weitere Informationen unter. Führen Sie einen benutzerdefinierten Belastungstest aus