Las traducciones son generadas a través de traducción automática. En caso de conflicto entre la traducción y la version original de inglés, prevalecerá la version en inglés.

Unidad organizativa de infraestructura: cuenta de red

| Influya en el futuro de la arquitectura de referencia de AWS seguridad (AWS SRA) realizando una breve encuesta |

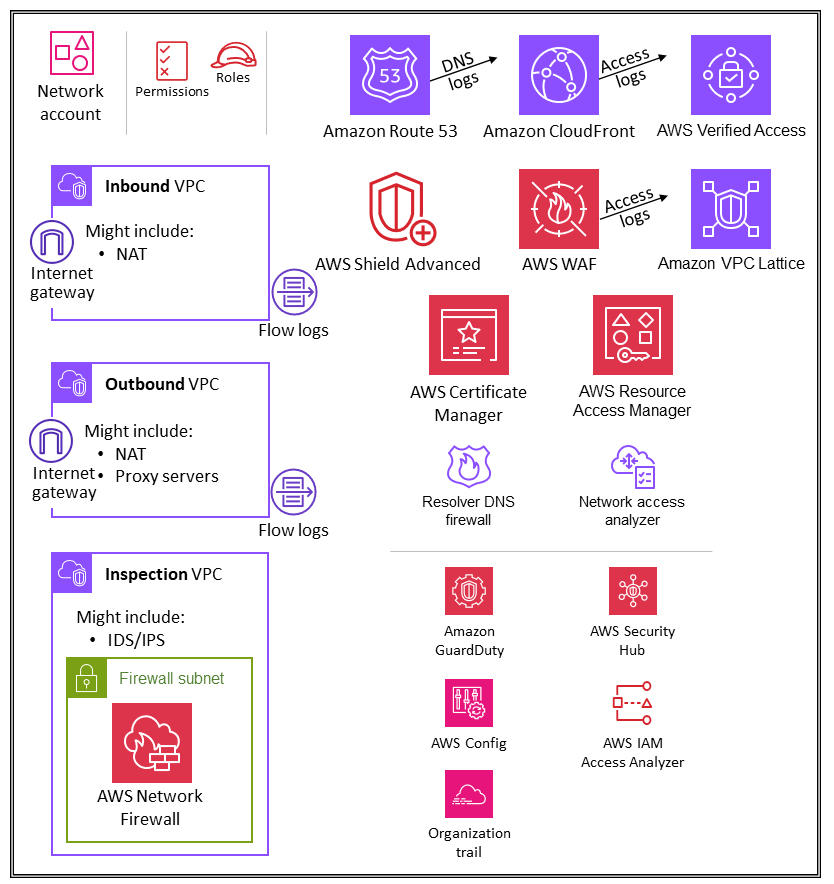

El siguiente diagrama ilustra los servicios AWS de seguridad que están configurados en la cuenta de red.

La cuenta de red administra la puerta de enlace entre la aplicación y el resto de Internet. Es importante proteger esa interfaz bidireccional. La cuenta de red aísla los servicios, la configuración y el funcionamiento de la red de las cargas de trabajo de las aplicaciones individuales, la seguridad y otras infraestructuras. Este mecanismo no solo limita la conectividad, los permisos y el flujo de datos, sino que también permite la separación de tareas y el uso de privilegios mínimos para los equipos que necesitan operar en estas cuentas. Al dividir el flujo de la red en nubes privadas virtuales entrantes y salientes independientes (VPCs), puede proteger la infraestructura y el tráfico confidenciales del acceso no deseado. Por lo general, la red entrante se considera de mayor riesgo y merece un enrutamiento y una supervisión adecuados y la mitigación de posibles problemas. Estas cuentas de infraestructura heredarán las barreras de protección de permisos de la cuenta de administración de la organización y de la unidad organizativa de infraestructura. Los equipos de redes (y seguridad) administran la mayor parte de la infraestructura de esta cuenta.

Arquitectura de redes

Si bien el diseño y las especificaciones de la red van más allá del alcance de este documento, recomendamos estas tres opciones para la conectividad de red entre las distintas cuentas: interconexión de VPC y. AWS PrivateLink AWS Transit Gateway A la hora de elegir una de estas opciones, es importante tener en cuenta las normas operativas, los presupuestos y las necesidades específicas de ancho de banda.

-

Emparejamiento de VPC: la forma más sencilla de conectar dos VPCs es utilizar el emparejamiento de VPC. Una conexión permite una conectividad bidireccional total entre. VPCs VPCs que están en cuentas separadas y que también Regiones de AWS se pueden emparejar entre sí. A gran escala, cuando se tienen decenas o cientos de ellas VPCs, interconectarlas con la interconexión se traduce en una malla de cientos o miles de conexiones entre pares, lo que puede resultar difícil de gestionar y escalar. El emparejamiento de VPC se utiliza mejor cuando los recursos de una VPC deben comunicarse con los recursos de otra VPC, el entorno de ambas VPCs está controlado y protegido y el número de personas a conectar es inferior VPCs a 10 (para permitir la administración individual de cada conexión).

-

AWS PrivateLink

‒ PrivateLink proporciona conectividad privada entre servicios y VPCs aplicaciones. Puede crear su propia aplicación en su VPC y configurarla como un servicio PrivateLink con tecnología (denominado servicio de punto final). Otros AWS principales pueden crear una conexión desde su VPC a su servicio de punto final mediante un punto final de interfaz de VPC o un punto final de Gateway Load Balancer, según el tipo de servicio. Cuando lo usas PrivateLink, el tráfico del servicio no pasa a través de una red enrutable públicamente. Úselo PrivateLink cuando tenga una configuración cliente-servidor en la que desee dar a uno o más consumidores acceso VPCs unidireccional a un servicio o conjunto de instancias específicos en la VPC del proveedor de servicios. Esta también es una buena opción cuando los clientes y los servidores de los dos VPCs tienen direcciones IP superpuestas, ya que PrivateLink utiliza interfaces de red elásticas dentro de la VPC del cliente para que no haya conflictos de IP con el proveedor de servicios. -

AWS Transit Gateway

‒ Transit Gateway ofrece un hub-and-spoke diseño para la conexión VPCs y las redes locales como un servicio totalmente gestionado sin necesidad de aprovisionar dispositivos virtuales. AWS gestiona la alta disponibilidad y la escalabilidad. Una pasarela de tránsito es un recurso regional y puede conectar miles de personas VPCs dentro de la misma Región de AWS. Puede conectar su conectividad híbrida (VPN y AWS Direct Connect conexiones) a una única pasarela de tránsito, consolidando y controlando así toda la configuración de enrutamiento de su AWS organización en un solo lugar. Una puerta de enlace de tránsito resuelve la complejidad que implica la creación y administración de múltiples conexiones de emparejamiento de VPC a escala. Es la opción predeterminada para la mayoría de las arquitecturas de red, pero las necesidades específicas en cuanto al costo, el ancho de banda y la latencia pueden hacer que la interconexión de VPC se adapte mejor a sus necesidades.

VPC entrante (de entrada)

La VPC entrante está diseñada para aceptar, inspeccionar y enrutar las conexiones de red iniciadas desde fuera de la aplicación. Según las características específicas de la aplicación, puede esperar ver alguna que otra traducción de direcciones de red (NAT) en esta VPC. Los registros de flujo de esta VPC se capturan y almacenan en la cuenta de archivo de registro.

VPC saliente (de salida)

La VPC saliente está destinada a administrar las conexiones de red iniciadas desde la aplicación. Según las características específicas de la aplicación, puede esperar ver tráfico NAT, puntos de enlace de Servicio de AWS VPC específicos y alojamiento de puntos de enlace de API externos en esta VPC. Los registros de flujo de esta VPC se capturan y almacenan en la cuenta de archivo de registro.

VPC de inspección

Una VPC de inspección dedicada proporciona un enfoque simplificado y central para gestionar las inspecciones entre Internet y las redes locales VPCs (en la misma o en diferentes Regiones de AWS). Para la AWS SRA, asegúrese de que todo el tráfico intermedio VPCs pase por la VPC de inspección y evite utilizar la VPC de inspección para cualquier otra carga de trabajo.

AWS Network Firewall

AWS Network Firewall

El firewall se utiliza por zona de disponibilidad en la VPC. Para cada zona de disponibilidad, elige una subred para alojar el punto de conexión del firewall que filtra su tráfico. El punto de conexión del firewall de una zona de disponibilidad puede proteger todas las subredes de la zona, excepto la subred en la que se encuentra. Según el caso de uso y el modelo de implementación, la subred del firewall puede ser pública o privada. El firewall es completamente transparente en cuanto al flujo de tráfico y no traduce direcciones de red (NAT). Conserva la dirección de origen y destino. En esta arquitectura de referencia, los puntos de conexión del firewall se alojan en una VPC de inspección. Todo el tráfico de la VPC entrante y hacia la VPC saliente se enruta a través de esta subred de firewall para su inspección.

Network Firewall hace que la actividad del firewall sea visible en tiempo real a través de CloudWatch las métricas de Amazon y ofrece una mayor visibilidad del tráfico de red mediante el envío de registros a Amazon Simple Storage Service (Amazon S3) CloudWatch y Amazon Data Firehose. Network Firewall es interoperable con su enfoque de seguridad actual, incluidas las tecnologías de AWS

los socios

En la AWS SRA, Network Firewall se usa dentro de la cuenta de red porque la funcionalidad del servicio centrada en el control de la red se alinea con la intención de la cuenta.

Consideraciones sobre el diseño

-

AWS Firewall Manager es compatible con Network Firewall, por lo que puede configurar e implementar de forma centralizada las reglas de Network Firewall en toda su organización. (Para obtener más información, consulte Uso de AWS Network Firewall políticas en Firewall Manager en la AWS documentación). Al configurar el Firewall Manager, se crea automáticamente un firewall con conjuntos de reglas en las cuentas y VPCs que usted especifique. También implementa un punto de conexión en una subred dedicada para cada zona de disponibilidad que contenga subredes públicas. Al mismo tiempo, cualquier cambio que se efectúa en el conjunto de reglas configurado centralmente se propaga de forma automática a los firewalls de Network Firewall implementados.

-

Existen varios modelos de implementación

disponibles con Network Firewall. El modelo correcto depende de su caso de uso y sus requisitos. Algunos ejemplos son los siguientes: -

Un modelo de despliegue distribuido en el que Network Firewall se despliega de forma individual VPCs.

-

Un modelo de implementación centralizada en el que Network Firewall se implementa en una VPC centralizada para el tráfico este-oeste (de VPC a VPC) o norte-sur (entrada y salida de Internet, en las instalaciones).

-

Un modelo de implementación combinado en el que Network Firewall se implementa en una VPC centralizada para el tráfico este-oeste y un subconjunto del tráfico norte-sur.

-

-

Como recomendación, no utilice la subred de Network Firewall para implementar cualquier otro servicio. Esto se debe a que Network Firewall no puede inspeccionar el tráfico de orígenes o destinos dentro de la subred de un firewall.

Analizador de acceso a la red

Analizador de acceso a la red es una característica de Amazon VPC que identifica el acceso de red no deseado a sus recursos. Puede usar Analizador de acceso a la red para validar la segmentación de la red, identificar los recursos a los que se puede acceder desde Internet o a los que solo se puede acceder desde rangos de direcciones IP confiables y validar que cuenta con los controles de red adecuados en todas las rutas de red.

El analizador de acceso a la red utiliza algoritmos de razonamiento automatizados para analizar las rutas de red que un paquete puede recorrer entre los recursos de una AWS red y produce resultados para las rutas que coinciden con el alcance de acceso a la red definido. Analizador de acceso a la red realiza un análisis estático de una configuración de red, lo que significa que no se transmite ningún paquete en la red como parte de este análisis.

Las reglas de Accesibilidad de la red de Amazon Inspector proporcionan una característica relacionada. Los resultados generados por estas reglas se utilizan en la cuenta de aplicación. Tanto Network Access Analyzer como Network Reachability utilizan la tecnología más reciente de la iniciativa de seguridad AWS demostrable

La cuenta de red define la infraestructura de red crítica que controla el tráfico que entra y sale de su AWS entorno. Este tráfico debe supervisarse rigurosamente. En la AWS SRA, el analizador de acceso a la red se usa dentro de la cuenta de red para ayudar a identificar el acceso no deseado a la red, identificar los recursos accesibles a Internet a través de las puertas de enlace de Internet y verificar que los controles de red adecuados, como los firewalls de red y las puertas de enlace NAT, estén presentes en todas las rutas de red entre los recursos y las puertas de enlace de Internet.

Consideración del diseño

El analizador de acceso a la red es una función de Amazon VPC y se puede usar en Cuenta de AWS cualquier VPC que tenga una VPC. Los administradores de red pueden asignar funciones de IAM específicas y multicuentas para validar que las rutas de red aprobadas se apliquen en cada una de ellas. Cuenta de AWS

AWS RAM

AWS Resource Access Manager

AWS RAM le permite compartir recursos que no son compatibles con las políticas de IAM basadas en recursos, como las subredes de VPC y las reglas de Route 53. Además AWS RAM, los propietarios de un recurso pueden ver qué directores tienen acceso a los recursos individuales que han compartido. Los directores de IAM pueden recuperar directamente la lista de recursos que han compartido con ellos, lo que no pueden hacer con los recursos compartidos por las políticas de recursos de IAM. Si AWS RAM se utiliza para compartir recursos fuera de la AWS organización, se inicia un proceso de invitación. El destinatario debe aceptar la invitación antes de conceder el acceso a los recursos. Esto proporciona controles y contrapesos adicionales.

AWS RAM lo invoca y administra el propietario del recurso, en la cuenta en la que se implementa el recurso compartido. Un caso de uso común que AWS RAM se ilustra en la AWS SRA es que los administradores de red compartan las subredes de VPC y las puertas de enlace de tránsito con toda la organización. AWS

Esto proporciona la posibilidad de separar las funciones de administración de la red Cuenta de AWS y ayuda a lograr la separación de funciones. Para obtener más información sobre el uso compartido de VPC, consulte la AWS entrada del blog Uso compartido de VPC: un nuevo enfoque para la administración de múltiples cuentas y VPC y

Consideración del diseño

Si bien AWS RAM un servicio se implementa solo dentro de la cuenta de red de la AWS SRA, normalmente se implementa en más de una cuenta. Por ejemplo, puede centralizar la administración de su lago de datos en una sola cuenta de lago de datos y, a continuación, compartir los recursos del catálogo de AWS Lake Formation datos (bases de datos y tablas) con otras cuentas de su AWS organización. Para obtener más información, consulte la AWS Lake Formation

documentación y la entrada del AWS blog Comparta sus datos de forma segura entre usuarios Cuentas de AWS . AWS Lake Formation

Acceso verificado de AWS

Acceso verificado de AWS

Acceso verificado admite dos patrones comunes de aplicaciones corporativas: internas y con acceso a Internet. Acceso verificado se integra con las aplicaciones mediante equilibradores de carga de aplicación o interfaces de red elásticas. Si utilizas un Application Load Balancer, Verified Access requiere un balanceador de carga interno. Dado que Verified Access es compatible AWS WAF a nivel de instancia, una aplicación existente que se AWS WAF integre con un Application Load Balancer puede mover políticas del balanceador de carga a la instancia de Verified Access. Una aplicación corporativa se representa como un punto de conexión de Acceso verificado. Cada punto de conexión está asociado a un grupo de Acceso verificado y hereda la política de acceso del grupo. Un grupo de Acceso verificado es un conjunto de puntos de conexión de Acceso verificado y una política de Acceso verificado a nivel de grupo. Los grupos simplifican la administración de políticas y permiten a los administradores de TI establecer criterios básicos. Los propietarios de las aplicaciones pueden definir con más detalle las políticas detalladas en función de la sensibilidad de la aplicación.

En la AWS SRA, el acceso verificado se aloja en la cuenta de red. El equipo central de TI establece las configuraciones administradas de forma centralizada. Por ejemplo, puede conectar proveedores de confianza, como proveedores de identidad (por ejemplo, Okta) y proveedores de confianza de dispositivos (por ejemplo, Jamf), crear grupos y determinar la política a nivel de grupo. Luego, estas configuraciones se pueden compartir con decenas, cientos o miles de cuentas de carga de trabajo mediante AWS RAM el uso de. Esto permite a los equipos de aplicaciones gestionar los puntos finales subyacentes que gestionan sus aplicaciones sin sobrecargar a otros equipos. AWS RAM proporciona una forma escalable de aprovechar el acceso verificado para las aplicaciones corporativas alojadas en diferentes cuentas de carga de trabajo.

Consideración del diseño

Puede agrupar los puntos de conexión para aplicaciones que tengan requisitos de seguridad similares para simplificar la administración de políticas y luego compartir el grupo con las cuentas de aplicación. Todas las aplicaciones del grupo comparten la política de grupo. Si una aplicación del grupo requiere una política específica debido a un caso extremo, puede aplicar una política a nivel de aplicación para esa aplicación.

Amazon VPC Lattice

Amazon VPC Lattice

VPC Lattice se integra AWS RAM para permitir el uso compartido de servicios y redes de servicios. AWS SRA describe una arquitectura distribuida en la que los desarrolladores o propietarios de servicios crean servicios de VPC Lattice en su cuenta de aplicación. Los propietarios de los servicios definen los oyentes, las reglas de enrutamiento y los grupos objetivo junto con las políticas de autenticación. A continuación, comparten los servicios con otras cuentas y los asocian a las redes de servicios de VPC Lattice. Los administradores de red crean estas redes en la cuenta de red y las comparten con la cuenta de aplicación. Los administradores de red configuran las políticas de autenticación y el monitoreo a nivel de la red de servicios. Los administradores asocian VPCs los servicios de VPC Lattice a una o más redes de servicios. Para obtener un recorrido detallado de esta arquitectura distribuida, consulte la entrada del AWS blog Cree una conectividad segura de múltiples cuentas y múltiples VPC para sus aplicaciones con Amazon

Consideraciones sobre el diseño

-

Según el modelo operativo de servicio de su organización o la visibilidad de la red de servicios, los administradores de red pueden compartir sus redes de servicios y dar a los propietarios de los servicios el control necesario para asociar sus servicios y a estas redes de servicios. VPCs O bien, los propietarios de los servicios pueden compartir sus servicios y los administradores de red pueden asociar los servicios a las redes de servicios.

-

Un cliente puede enviar solicitudes a servicios asociados con una red de servicios solo si el cliente está en una VPC asociada con la misma red de servicios. Se deniega el tráfico de clientes que atraviesa una conexión de emparejamiento de VPC o una puerta de enlace de tránsito.

Seguridad de la periferia

La seguridad perimetral generalmente implica tres tipos de protecciones: la entrega segura de contenido, la protección de la red y la capa de aplicaciones y la mitigación de las denegaciones de servicio distribuidasDDo. El contenido, como datos, vídeos y APIs aplicaciones, debe entregarse de forma rápida y segura, utilizando la versión recomendada de TLS para cifrar las comunicaciones entre los puntos finales. El contenido también debe tener restricciones de acceso mediante cookies URLs firmadas y autenticadas mediante token. La seguridad a nivel de aplicación debe diseñarse para controlar el tráfico de bots, bloquear los patrones de ataque más comunes, como la inyección de código SQL o scripting entre sitios (XSS), y proporcionar visibilidad del tráfico web. En la periferia, DDo la mitigación de las emisiones de carbono proporciona una importante capa de defensa que garantiza la disponibilidad continua de las operaciones y los servicios empresariales fundamentales para la misión. Las aplicaciones APIs deben estar protegidas contra las inundaciones de SYN, las inundaciones de UDP u otros ataques de reflexión, y contar con una mitigación integrada para detener los ataques básicos a la capa de red.

AWS ofrece varios servicios para ayudar a proporcionar un entorno seguro, desde la nube central hasta el borde de la red. AWS Amazon CloudFront AWS Certificate Manager (ACM) y Amazon Route 53 trabajan juntos para ayudar a crear un perímetro de seguridad flexible y en capas. AWS Shield AWS WAF El contenido o las aplicaciones se pueden entregar a través de HTTPS mediante TLSv1 0.3 para cifrar y proteger la comunicación entre los espectadores, los clientes y. CloudFront APIs CloudFront Puede usar ACM para crear un certificado SSL personalizado

Amazon CloudFront

Amazon CloudFront

CloudFront ofrece varias opciones para proteger y restringir el acceso a su contenido. Por ejemplo, puede restringir el acceso a su origen de Amazon S3 mediante el uso de cookies firmadas URLs y firmadas. Para obtener más información, consulte Configurar el acceso seguro y restringir el acceso al contenido en la CloudFront documentación.

La AWS SRA ilustra CloudFront las distribuciones centralizadas en la cuenta de red porque se alinean con el patrón de red centralizada que se implementa mediante el uso. AWS Transit Gateway Al implementar y administrar CloudFront las distribuciones en la cuenta de red, obtiene los beneficios de los controles centralizados. Puede administrar todas CloudFront las distribuciones en un solo lugar, lo que facilita el control del acceso, la configuración de los ajustes y la supervisión del uso en todas las cuentas. Además, puede administrar los certificados ACM, los registros de DNS y los CloudFront registros desde una cuenta centralizada.

El panel CloudFront de seguridad proporciona AWS WAF visibilidad y controles directamente en su CloudFront distribución. Obtendrá visibilidad de las principales tendencias de seguridad de su aplicación, del tráfico permitido y bloqueado y de la actividad de los bots. Puede utilizar herramientas de investigación, como analizadores visuales de registros y controles de bloqueo integrados, para aislar los patrones de tráfico y bloquear el tráfico sin consultar los registros ni escribir reglas de seguridad.

Consideraciones sobre el diseño

-

Como alternativa, puede implementarla CloudFront como parte de la aplicación en la cuenta de la aplicación. En este escenario, el equipo de aplicaciones toma decisiones como la forma de implementar las CloudFront distribuciones, determina las políticas de caché adecuadas y asume la responsabilidad de la gobernanza, la auditoría y la supervisión de las CloudFront distribuciones. Al distribuir CloudFront las distribuciones entre varias cuentas, puede beneficiarse de cuotas de servicio adicionales. Como otra ventaja, puede utilizar CloudFront la configuración de identidad de acceso de origen (OAI) y control de acceso de origen (OAC) inherente y automatizada para restringir el acceso a los orígenes de Amazon S3.

-

Cuando publica contenido web a través de una CDN, por ejemplo CloudFront, debe evitar que los espectadores pasen por alto la CDN y accedan directamente a su contenido original. Para lograr esta restricción de acceso al origen, puedes usar CloudFront y AWS WAF añadir encabezados personalizados y verificar los encabezados antes de reenviar las solicitudes a tu origen personalizado. Para obtener una explicación detallada de esta solución, consulta la entrada del blog sobre AWS seguridad Cómo mejorar la seguridad de Amazon CloudFront Origin con AWS WAF y AWS Secrets Manager

. Un método alternativo consiste en limitar únicamente la lista de CloudFront prefijos del grupo de seguridad asociado al Application Load Balancer. Esto ayudará a garantizar que solo una CloudFront distribución pueda acceder al balanceador de cargas.

AWS WAF

AWS WAF

AWS WAF utiliza listas de control de acceso web (ACLs) para proteger un conjunto de recursos. AWS Una ACL web es un conjunto de reglas que define los criterios de inspección y la acción asociada que se debe realizar (bloquear, permitir, contar o ejecutar el control de bots) si una solicitud web cumple con los criterios. AWS WAF proporciona un conjunto de reglas administradas

AWS WAF proporciona un conjunto de reglas inteligentes gestionadas por niveles para bots comunes y específicos y para la protección contra el robo de cuentas (ATP). Se le cobrará una cuota de suscripción y una cuota de inspección de tráfico cuando utilice los grupos de reglas de ATP y control de bots. Por lo tanto, le recomendamos que primero supervise su tráfico y luego decida qué utilizar. Puedes utilizar los paneles de administración de bots y de apropiación de cuentas que están disponibles de forma gratuita en la AWS WAF consola para supervisar estas actividades y, a continuación, decidir si necesitas un grupo de reglas de nivel inteligente. AWS WAF

En la AWS SRA, AWS WAF está integrado CloudFront en la cuenta de red. En esta configuración, el procesamiento de AWS WAF reglas se realiza en las ubicaciones de borde en lugar de dentro de la VPC. Esto permite filtrar el tráfico malintencionado más cerca del usuario final que solicitó el contenido y ayuda a impedir que dicho tráfico entre en la red principal.

Puede enviar AWS WAF registros completos a un bucket de S3 de la cuenta de Log Archive configurando el acceso multicuenta al bucket de S3. Para obtener más información, consulte el artículo de AWS

Re:post sobre este tema

Consideraciones sobre el diseño

-

Como alternativa a la implementación AWS WAF centralizada en la cuenta de red, algunos casos de uso se resuelven mejor si la implementación se realiza AWS WAF en la cuenta de aplicación. Por ejemplo, puede elegir esta opción cuando implemente sus CloudFront distribuciones en su cuenta de aplicación o tenga balanceadores de carga de aplicaciones públicos, o si usa API Gateway delante de sus aplicaciones web. Si decide realizar la implementación AWS WAF en cada cuenta de aplicación, úsela AWS Firewall Manager para administrar AWS WAF las reglas de estas cuentas desde la cuenta centralizada de Security Tooling.

-

También puede agregar AWS WAF reglas generales en la CloudFront capa y reglas adicionales específicas de la aplicación AWS WAF en un recurso regional, como Application Load Balancer o la puerta de enlace de API.

AWS Shield

AWS Shield

Puede usar la función de mitigación automática de la capa DDo S de aplicaciones de Shield Advanced para configurar Shield Advanced para que responda automáticamente y mitigue los ataques de la capa de aplicaciones (capa 7) contra sus CloudFront distribuciones protegidas, los balanceadores de carga de Elastic Load Balancing (Elastic Load Balancing) (Application, Network y Classic), las zonas alojadas de Amazon Route 53, las direcciones IP de Amazon EC2 Elastic y los aceleradores AWS Global Accelerator estándar. Al activar esta función, Shield Advanced genera automáticamente AWS WAF reglas personalizadas para mitigar los ataques DDo S. Shield Advanced también te da acceso al equipo de AWS Shield respuesta (SRT). Puede ponerse en contacto con SRT en cualquier momento para crear y gestionar mitigaciones personalizadas para su aplicación o durante un ataque S activo. DDo Si desea que SRT supervise de forma proactiva sus recursos protegidos y se ponga en contacto con usted durante un DDo intento de ataque, considere la posibilidad de habilitar la función de participación proactiva.

Consideraciones sobre el diseño

-

Si tiene cargas de trabajo gestionadas por recursos con acceso a Internet en la cuenta de la aplicación, como un Application Load Balancer o un Network Load Balancer CloudFront, configure Shield Advanced en la cuenta de la aplicación y añada esos recursos a la protección Shield. Puede utilizarlas para configurar estas opciones AWS Firewall Manager a escala.

-

Si tiene varios recursos en el flujo de datos, como una CloudFront distribución delante de un Application Load Balancer, utilice solo el recurso de punto de entrada como recurso protegido. Esto garantizará que no pague dos veces las tarifas de transferencia de datos salientes (DTO) de Shield

por dos recursos. -

Shield Advanced registra las métricas que puedes supervisar en Amazon CloudWatch. (Para obtener más información, consulte Monitorización con Amazon CloudWatch en la AWS documentación). Configure CloudWatch alarmas para recibir notificaciones de SNS en su centro de seguridad cuando se detecte un evento DDo S. En caso de sospecha de un caso DDo S, póngase en contacto con el equipo de AWS Enterprise Support

presentando un ticket de soporte y asignándole la máxima prioridad. El equipo de Enterprise Support incluirá al equipo de respuesta de Shield (SRT) cuando se encargue del evento. Además, puede preconfigurar la función Lambda de AWS Shield contratación para crear un ticket de soporte y enviar un correo electrónico al equipo de SRT.

AWS Certificate Manager (ACM)

AWS Certificate Manager

El ACM se utiliza en la cuenta de red para generar un certificado TLS público que, a su vez, lo utilizan CloudFront las distribuciones para establecer la conexión HTTPS entre los espectadores y. CloudFront Para obtener más información, consulte la Documentación de CloudFront .

Consideración del diseño

En el caso de los certificados externos, ACM debe residir en la misma cuenta que los recursos para los que aprovisiona los certificados. Los certificados no se pueden compartir entre cuentas.

Amazon Route 53

Amazon Route 53

Puede usar Route 53 como un servicio de DNS para asignar nombres de dominio a sus EC2 instancias, depósitos de S3, CloudFront distribuciones y otros recursos. AWS La naturaleza distribuida de los servidores AWS DNS ayuda a garantizar que los usuarios finales se dirijan a la aplicación de forma coherente. Características como el flujo de tráfico de Route 53 y el control de enrutamiento le ayudan a mejorar la confiabilidad. Si el punto de conexión de su aplicación principal deja de estar disponible, puede configurar la conmutación por error para redirigir a los usuarios a una ubicación alternativa. Route 53 Resolver proporciona un DNS recursivo para su VPC y sus redes locales a AWS Direct Connect través AWS de una VPN administrada o gestionada.

Al usar el servicio de IAM con Route 53, tienes un control detallado sobre quién puede actualizar tus datos de DNS. Puede habilitar la firma de extensiones de seguridad de DNS (DNSSEC) para permitir que los solucionadores de DNS validen que una respuesta de DNS provino de Route 53 y no haya sido manipulada.

El firewall DNS de Route 53 Resolver brinda protección para las solicitudes de DNS salientes de su. VPCs Estas solicitudes pasan por Route 53 Resolver para la resolución de nombres de dominio. Un uso principal de las protecciones de DNS Firewall es ayudar a evitar la filtración de datos DNS. Con DNS Firewall, puede monitorear y controlar los dominios que las aplicaciones pueden consultar. Puede denegar el acceso a los dominios que sabe que son malos y permitir que pasen el resto de las consultas. También puede denegar el acceso a todos los dominios, excepto a aquellos en los que confía explícitamente. También puede utilizar DNS Firewall para bloquear las solicitudes de resolución a los recursos de zonas alojadas privadas (compartidas o locales), incluidos los nombres de los puntos de conexión de VPC. También puede bloquear las solicitudes de nombres de EC2 instancias públicas o privadas.

Los solucionadores de Route 53 se crean de forma predeterminada como parte de cada VPC. En la AWS SRA, Route 53 se usa en la cuenta de red principalmente para la función de firewall de DNS.

Consideración del diseño

Tanto el firewall de DNS AWS Network Firewall como ambos ofrecen filtrado de nombres de dominio, pero para distintos tipos de tráfico. Puede usar DNS Firewall y Network Firewall juntos para configurar el filtrado basado en el dominio para el tráfico de la capa de aplicaciones en dos rutas de red diferentes:

-

El firewall de DNS filtra las consultas de DNS salientes que pasan por el Route 53 Resolver desde las aplicaciones de su servidor. VPCs También puede configurar DNS Firewall a fin de enviar respuestas personalizadas para las consultas a nombres de dominio bloqueados.

-

Network Firewall proporciona filtrado para el tráfico de la capa de red y de aplicación, pero no tiene visibilidad de las consultas que realiza Route 53 Resolver.