Las traducciones son generadas a través de traducción automática. En caso de conflicto entre la traducción y la version original de inglés, prevalecerá la version en inglés.

Explicabilidad en línea con Clarify SageMaker

Esta guía muestra cómo configurar la explicabilidad en línea con Clarify. SageMaker Con los puntos finales de inferencia en tiempo real de la SageMaker IA, puede analizar la explicabilidad en tiempo real y de forma continua. La función de explicabilidad en línea se integra en la parte de implementación para producción del flujo de trabajo de Amazon SageMaker AI Machine Learning.

Cómo funciona la explicabilidad en línea de Clarify

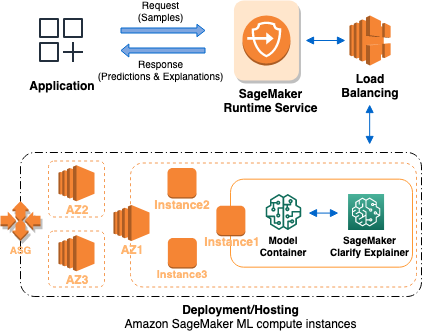

En el siguiente gráfico, se muestra la arquitectura de SageMaker IA para alojar un terminal que responde a las solicitudes de explicabilidad. Describe las interacciones entre un punto final, el contenedor modelo y la herramienta explicativa de SageMaker Clarify.

Así es como funciona la explicabilidad en línea de Clarify. La aplicación envía una InvokeEndpoint solicitud REST de estilo al SageMaker AI Runtime Service. El servicio dirige esta solicitud a un punto final de SageMaker IA para obtener predicciones y explicaciones. A continuación, el servicio recibe la respuesta del punto de conexión. Por último, el servicio envía la respuesta de vuelta a la aplicación.

Para aumentar la disponibilidad de los puntos finales, la SageMaker IA intenta distribuir automáticamente las instancias de puntos finales en varias zonas de disponibilidad, según el número de instancias de la configuración del punto final. En una instancia de punto final, ante una nueva solicitud de explicabilidad, el explicador de SageMaker Clarify recurre al contenedor del modelo para realizar predicciones. A continuación, calcula y devuelve las atribuciones de características.

Estos son los cuatro pasos para crear un punto final que utilice SageMaker la explicabilidad en línea de Clarify:

-

Cree una configuración de punto final con la configuración explicativa de SageMaker Clarify utilizando el.

CreateEndpointConfigAPI -

Cree un punto final y proporcione la configuración del punto final a la SageMaker IA mediante el.

CreateEndpointAPI El servicio lanza la instancia de computación de ML e implementa el modelo según se especifica en la configuración. -

Invoca el punto final: una vez que el punto final esté en servicio, llama al SageMaker AI Runtime API

InvokeEndpointpara enviar solicitudes al punto final. A continuación, el punto de conexión devuelve las explicaciones y las predicciones.