Las traducciones son generadas a través de traducción automática. En caso de conflicto entre la traducción y la version original de inglés, prevalecerá la version en inglés.

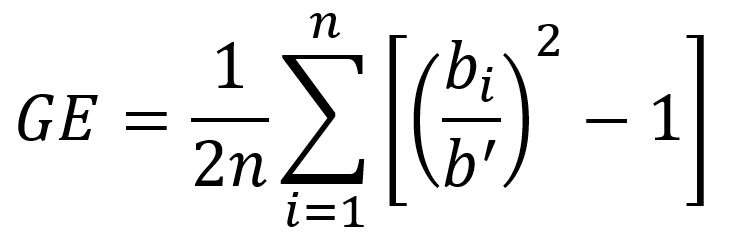

Entropía generalizada (GE)

El índice de entropía generalizada (GE) mide la desigualdad en el beneficio b de la etiqueta predicha en comparación con la etiqueta observada. Se produce un beneficio cuando se predice un falso positivo. Un falso positivo se produce cuando una observación negativa (y=0) tiene una predicción positiva (y'=1). También se produce un beneficio cuando las etiquetas observadas y predichas son las mismas, lo que también se conoce como verdadero positivo y verdadero negativo. No se obtiene ningún beneficio cuando se predice un falso negativo. Un falso negativo se produce cuando se predice que una observación positiva (y=1) tendrá un resultado negativo (y'=0). El beneficio b se define de la siguiente manera.

b = y' - y + 1

Según esta definición, un falso positivo recibe un beneficio b de 2 y un falso negativo recibe un beneficio de 0. Tanto un positivo verdadero como un negativo verdadero reciben un beneficio de 1.

La métrica GE se calcula siguiendo el índice de entropía generalizadaalpha establecida en 2. Esta ponderación controla la sensibilidad a diferentes valores de beneficio. Un alpha menor significa una mayor sensibilidad a valores más pequeños.

Las siguientes variables utilizadas para calcular la GE se definen de la siguiente manera:

-

bi es el beneficio que recibe el

ithpunto de datos. -

b' es la media de todos los beneficios.

La GE puede oscilar entre 0 y 0,5, donde los valores de cero indican que no hay desigualdad en los beneficios en todos los puntos de datos. Esto ocurre cuando todas las entradas se predicen correctamente o cuando todas las predicciones son falsos positivos. La GE no está definida cuando todas las predicciones son falsos negativos.

nota

La métrica GE no depende de que el valor de una faceta sea favorecido o desfavorecido.