Les traductions sont fournies par des outils de traduction automatique. En cas de conflit entre le contenu d'une traduction et celui de la version originale en anglais, la version anglaise prévaudra.

Didacticiel : Les premiers pas avec Amazon EMR

Parcourez un flux de travail pour configurer rapidement un cluster Amazon EMR et exécuter une application Spark.

Configuration de votre cluster Amazon EMR

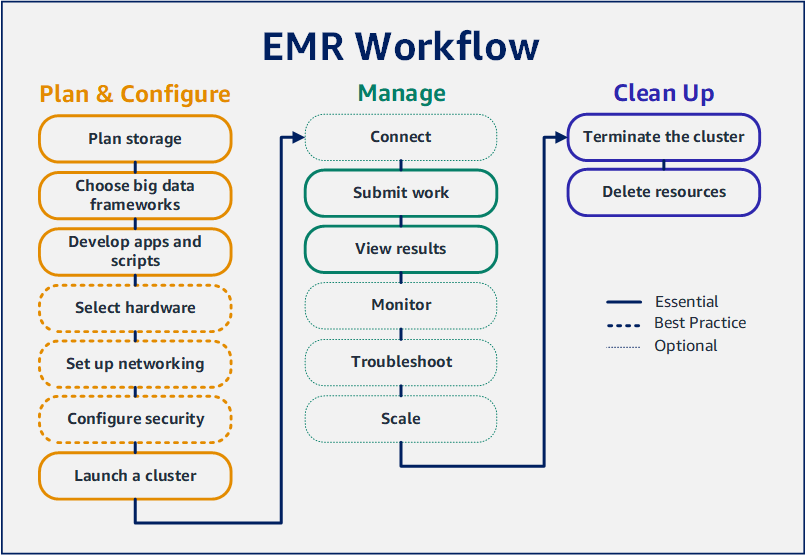

Avec Amazon EMR, vous pouvez configurer un cluster pour traiter et analyser des données avec des environnements de big data en quelques minutes seulement. Ce didacticiel explique comment lancer un exemple de cluster à l'aide de Spark et comment exécuter un PySpark script simple stocké dans un compartiment Amazon S3. Il couvre les tâches essentielles d'Amazon EMR dans trois catégories principales de flux de travail : planification et configuration, gestion et nettoyage.

Vous trouverez des liens vers des sujets plus détaillés au fur et à mesure que vous avancerez dans le didacticiel, ainsi que des idées d'étapes supplémentaires dans la section Étapes suivantes. Si vous avez des questions ou rencontrez des difficultés, contactez l'équipe d'Amazon EMR sur notre Forum de discussion

Conditions préalables

-

Avant de lancer un cluster Amazon EMR, assurez-vous d'avoir effectué les tâches décrites dans la rubrique Avant de configurer Amazon EMR.

Cost

-

L’exemple de cluster que vous créez s’exécute dans un environnement en direct. Le cluster enregistre des frais minimes. Pour éviter des frais supplémentaires, assurez-vous d'effectuer les tâches de nettoyage de la dernière étape de ce didacticiel. Les frais sont calculés au tarif par seconde conformément à la tarification Amazon EMR. Les frais varient également selon la région. Pour de plus amples informations, consultez la tarification Amazon EMR

. -

Des frais minimes pourraient s'accumuler pour les petits fichiers que vous stockez dans Amazon S3. Certains ou tous les frais d'Amazon S3 peuvent être annulés si vous respectez les limites d'utilisation du niveau AWS gratuit. Pour plus d'informations, consultez la rubrique Tarification Amazon S3

et Niveau gratuit AWS .

Étape 1 : Configuration des ressources de données et lancement d'un cluster Amazon EMR

Préparation du stockage pour Amazon EMR

Lorsque vous utilisez Amazon EMR, vous pouvez choisir parmi différents systèmes de fichiers pour stocker les données d'entrée, les données de sortie et les fichiers journaux. Dans ce didacticiel, vous utilisez EMRFS pour stocker des données dans un compartiment S3. EMRFS est une implémentation du système de fichiers Hadoop qui permet de lire et d'écrire des fichiers normaux sur Amazon S3. Pour de plus amples informations, veuillez consulter Utilisation de systèmes de stockage et de fichiers avec Amazon EMR.

Pour créer un compartiment pour ce didacticiel, suivez les instructions de la rubrique Comment créer un compartiment S3 ? dans le Guide de l'utilisateur de la console Amazon Simple Storage Service. Créez le compartiment dans la même AWS région où vous prévoyez de lancer votre cluster Amazon EMR. Par exemple, USA Ouest (Oregon) us-west-2.

Les compartiments et dossiers que vous utilisez avec Amazon EMR présentent les limites suivantes :

-

Les noms peuvent être composés de lettres minuscules, de chiffres, de points (.) et de traits d'union (-).

-

Les noms ne peuvent pas se terminer par des chiffres.

-

Le nom d'un compartiment doit être unique pour tous les comptes AWS .

-

Le dossier de sortie doit être vide.

Préparation d'une application avec des données d'entrée pour Amazon EMR

La façon la plus courante de préparer une application pour Amazon EMR consiste à télécharger l'application et ses données d'entrée sur Amazon S3. Ensuite, lorsque vous soumettez du travail à votre cluster, vous indiquez les emplacements Amazon S3 pour votre script et vos données.

Au cours de cette étape, vous chargez un exemple de PySpark script dans votre compartiment Amazon S3. Nous vous avons fourni un PySpark script que vous pouvez utiliser. Le script traite les données d'inspection des établissements alimentaires et renvoie un fichier de résultats dans votre compartiment S3. Le fichier des résultats répertorie les dix établissements ayant enregistré le plus grand nombre d'infractions de type « rouge ».

Vous chargez également des exemples de données d'entrée sur Amazon S3 pour que le PySpark script les traite. Les données d'entrée sont une version modifiée des résultats des inspections effectuées par le ministère de la Santé du comté de King, Washington, entre 2006 et 2020. Pour plus d'informations, consultez la rubrique Données ouvertes du comté de King : données sur l'inspection des établissements alimentaires

name,inspection_result,inspection_closed_business,violation_type,violation_points 100 LB CLAM,Unsatisfactory,FALSE,BLUE,5 100 PERCENT NUTRICION,Unsatisfactory,FALSE,BLUE,5 7-ELEVEN #2361-39423A,Complete,FALSE,,0

Pour préparer l'exemple de PySpark script pour EMR

-

Copiez l'exemple de code ci-dessous dans un nouveau fichier dans l'éditeur de votre choix.

import argparse from pyspark.sql import SparkSession def calculate_red_violations(data_source, output_uri): """ Processes sample food establishment inspection data and queries the data to find the top 10 establishments with the most Red violations from 2006 to 2020. :param data_source: The URI of your food establishment data CSV, such as 's3://amzn-s3-demo-bucket/food-establishment-data.csv'. :param output_uri: The URI where output is written, such as 's3://amzn-s3-demo-bucket/restaurant_violation_results'. """ with SparkSession.builder.appName("Calculate Red Health Violations").getOrCreate() as spark: # Load the restaurant violation CSV data if data_source is not None: restaurants_df = spark.read.option("header", "true").csv(data_source) # Create an in-memory DataFrame to query restaurants_df.createOrReplaceTempView("restaurant_violations") # Create a DataFrame of the top 10 restaurants with the most Red violations top_red_violation_restaurants = spark.sql("""SELECT name, count(*) AS total_red_violations FROM restaurant_violations WHERE violation_type = 'RED' GROUP BY name ORDER BY total_red_violations DESC LIMIT 10""") # Write the results to the specified output URI top_red_violation_restaurants.write.option("header", "true").mode("overwrite").csv(output_uri) if __name__ == "__main__": parser = argparse.ArgumentParser() parser.add_argument( '--data_source', help="The URI for you CSV restaurant data, like an S3 bucket location.") parser.add_argument( '--output_uri', help="The URI where output is saved, like an S3 bucket location.") args = parser.parse_args() calculate_red_violations(args.data_source, args.output_uri) -

Enregistrez le fichier sous le nom

health_violations.py. -

Chargez

health_violations.pysur Amazon S3 dans le compartiment que vous avez créé pour ce didacticiel. Pour obtenir des instructions, consultez la rubrique Chargement d'un objet dans un compartiment dans le Guide de démarrage Amazon Simple Storage Service.

Préparation des exemples de données d'entrée pour EMR

-

Téléchargez le fichier zip food_establishment_data.zip.

-

Décompressez et enregistrez

food_establishment_data.zipsous le nomfood_establishment_data.csvsur votre machine. -

Chargez le fichier CSV sur Amazon S3 dans le compartiment que vous avez créé pour ce didacticiel. Pour obtenir des instructions, consultez la rubrique Chargement d'un objet dans un compartiment dans le Guide de démarrage Amazon Simple Storage Service.

Pour plus d'informations sur la configuration des données pour EMR, consultez Préparer les données d'entrée pour le traitement avec Amazon EMR.

Lancement d'un cluster Amazon EMR

Après avoir préparé un emplacement de stockage et votre application, vous pouvez lancer un exemple de cluster Amazon EMR. Au cours de cette étape, vous lancez un cluster Apache Spark à l'aide de la dernière version d'Amazon EMR.

Étape 2 : Soumettre le travail à votre cluster Amazon EMR

Soumettre un travail et consulter les résultats

Après avoir lancé un cluster, vous pouvez soumettre du travail au cluster en cours d'exécution pour traiter et analyser des données. Vous soumettez votre travail à un cluster Amazon EMR en tant qu'étape. L'étape est une unité de travail composée d'une ou plusieurs actions. Par exemple, vous pouvez soumettre une étape pour calculer des valeurs ou pour transférer et traiter des données. Vous pouvez soumettre des étapes lors de la création d'un cluster ou à un cluster en cours d'exécution. Dans cette partie du didacticiel, vous soumettez health_violations.py en tant qu'étape à votre cluster en cours d'exécution. Pour en savoir plus sur les étapes, consultez Soumettre un travail à un cluster Amazon EMR.

Pour plus d'informations sur le cycle de vie des étapes, consultez Exécuter des étapes pour traiter des données.

Affichage des résultats

Une fois qu'une étape s'est exécutée avec succès, vous pouvez consulter ses résultats dans votre dossier de sortie Amazon S3.

Affichage des résultats de health_violations.py

Ouvrez la console Amazon S3 à l'adresse https://console.aws.amazon.com/s3/

. -

Choisissez le nom du compartiment, puis le dossier de sortie que vous avez spécifié lorsque vous avez soumis l'étape. Par exemple,

amzn-s3-demo-bucketpuismyOutputFolder. -

Vérifiez que les éléments suivants apparaissent dans votre dossier de sortie :

-

Un objet de petite taille appelé

_SUCCESS. -

Un fichier CSV commençant par le préfixe

part-qui contient vos résultats.

-

-

Choisissez l'objet contenant vos résultats, puis choisissez Télécharger pour enregistrer les résultats dans votre système de fichiers local.

-

Ouvrez le résultats dans l'éditeur de votre choix. Le fichier de sortie répertorie les dix établissements ayant enregistré le plus grand nombre d'infractions rouges. Le fichier de sortie indique également le nombre total d'infractions rouges pour chaque établissement.

Voici un exemple de résultats

health_violations.py.name, total_red_violations SUBWAY, 322 T-MOBILE PARK, 315 WHOLE FOODS MARKET, 299 PCC COMMUNITY MARKETS, 251 TACO TIME, 240 MCDONALD'S, 177 THAI GINGER, 153 SAFEWAY INC #1508, 143 TAQUERIA EL RINCONSITO, 134 HIMITSU TERIYAKI, 128

Pour plus d'informations sur la sortie des clusters Amazon EMR, consultez Configurer un emplacement pour la sortie du cluster Amazon EMR.

Lorsque vous utilisez Amazon EMR, vous souhaiterez peut-être vous connecter à un cluster en cours d'exécution pour lire les fichiers journaux, déboguer le cluster ou utiliser des outils de la CLI tels que le shell de Spark. Amazon EMR vous permet de vous connecter à un cluster à l'aide du protocole Secure Shell (SSH). Cette section explique comment configurer SSH, vous connecter à votre cluster et consulter les fichiers journaux de Spark. Pour plus d'informations sur la connexion à un cluster, consultez Authentification auprès des nœuds de cluster Amazon EMR.

Autorisation des connexions SSH à votre cluster

Avant de vous connecter à votre cluster, vous devez modifier les groupes de sécurité de votre cluster pour autoriser les connexions SSH entrantes. Les groupes de sécurité Amazon EC2 agissent en tant que pares-feux virtuels pour contrôler le trafic entrant et sortant de votre cluster. Lorsque vous avez créé votre cluster pour ce didacticiel, Amazon EMR a créé les groupes de sécurité suivants en votre nom :

- ElasticMapReduce-maître

-

Le groupe de sécurité gérés Amazon EMR par défaut, associé au nœud primaire. Dans un cluster Amazon EMR, le nœud primaire est une instance Amazon EC2 qui gère le cluster.

- ElasticMapReduce-esclave

-

Groupe de sécurité par défaut associé aux nœuds principaux et aux nœuds de tâches.

Connectez-vous à votre cluster à l'aide du AWS CLI

Quel que soit votre système d'exploitation, vous pouvez créer une connexion SSH à votre cluster à l'aide de la AWS CLI.

Pour vous connecter à votre cluster et consulter les fichiers journaux à l'aide du AWS CLI

-

Utilisez la commande suivante pour ouvrir une connexion SSH à votre cluster.

<mykeypair.key>Remplacez-le par le chemin complet et le nom de fichier de votre fichier de paires de clés. Par exemple,C:\Users\<username>\.ssh\mykeypair.pem.aws emr ssh --cluster-id<j-2AL4XXXXXX5T9>--key-pair-file<~/mykeypair.key> -

Naviguez vers

/mnt/var/log/sparkpour accéder aux journaux Spark sur le nœud principal de votre cluster. Affichez ensuite les fichiers qui se trouvent à cet emplacement. Pour obtenir la liste des fichiers journaux supplémentaires sur le nœud principal, consultez Affichage des fichiers journaux sur le nœud primaire.cd /mnt/var/log/spark ls

Amazon EMR sur EC2 est également un type de calcul pris en charge par Unified Studio. Amazon SageMaker AI Reportez-vous à la section Gestion d'Amazon EMR sur EC2 pour savoir comment utiliser et gérer les ressources EMR sur EC2 dans Unified Studio. Amazon SageMaker AI

Étape 3 : Nettoyer vos ressources Amazon EMR

Arrêt de votre cluster

Maintenant que vous avez soumis du travail à votre cluster et que vous avez consulté les résultats de votre PySpark application, vous pouvez mettre fin au cluster. L'arrêt du cluster arrête toutes les charges Amazon EMR et les instances Amazon EC2 qui lui sont associées.

Lorsque vous arrêtez un cluster, Amazon EMR conserve gratuitement les métadonnées relatives au cluster pendant deux mois. Les métadonnées archivées vous permettent de cloner le cluster pour une nouvelle tâche ou de retenir la configuration du cluster à des fins de référence. Les métadonnées n'incluent pas les données que le cluster écrit dans S3, ni les données stockées dans HDFS sur le cluster.

Note

La console Amazon EMR ne vous permet pas de supprimer un cluster de la vue de la liste après avoir arrêté le cluster. Le cluster arrêté disparaît de la console lorsqu'Amazon EMR efface ses métadonnées.

Suppression des ressources S3

Pour éviter des frais supplémentaires, vous devez supprimer votre compartiment Amazon S3. La suppression du compartiment entraîne la suppression de toutes les ressources Amazon S3 pour ce didacticiel. Votre compartiment doit contenir :

-

Le PySpark script

-

Le jeu de données d'entrée

-

Votre dossier de résultats de sortie

-

Votre dossier de fichiers journaux

Vous devrez peut-être prendre des mesures supplémentaires pour supprimer les fichiers stockés si vous avez enregistré votre PySpark script ou votre sortie dans un autre emplacement.

Note

Votre cluster doit être arrêté avant que vous ne supprimiez votre compartiment. Sinon, vous risquez de ne pas être autorisé à vider le compartiment.

Pour supprimer votre compartiment, suivez les instructions de la rubrique Comment supprimer un compartiment S3 ? dans le Guide de l'utilisateur Amazon Simple Storage Service.

Étapes suivantes

Vous venez de lancer votre premier cluster Amazon EMR du début à la fin. Vous avez également effectué des tâches EMR essentielles telles que la préparation et la soumission des applications de big data, la visualisation des résultats et l'arrêt d'un cluster.

Consultez les rubriques suivantes pour en savoir plus sur la manière dont vous pouvez personnaliser votre flux de travail Amazon EMR.

Découvrez les applications de big data pour Amazon EMR

Découvrez et comparez les applications de big data que vous pouvez installer sur un cluster dans le Guide de mise à jour d'Amazon EMR. Le guide de mise à jour détaille chaque version EMR et comprend des conseils pour l'utilisation d'environnements tels que Spark et Hadoop sur Amazon EMR.

Planification du matériel, de la mise en réseau et de la sécurité du cluster

Dans ce didacticiel, vous avez créé un cluster EMR simple sans configurer d'options avancées. Les options avancées vous permettent de spécifier les types d'instances Amazon EC2, le réseau du cluster et la sécurité du cluster. Pour plus d'informations sur la planification et le lancement d'un cluster répondant à vos besoins, consultez Planifier, configurer et lancer des clusters Amazon EMR et Sécurité dans Amazon EMR.

Gestion des clusters

Approfondissez l'utilisation de clusters en cours d'exécution dans Gérer les clusters Amazon EMR. Pour gérer un cluster, vous pouvez vous connecter au cluster, effectuer les étapes de débogage et suivre les activités et l'état du cluster. Vous pouvez également ajuster les ressources du cluster en fonction des demandes de charge de travail grâce à la mise à l'échelle gérée par EMR.

Utilisation d'une interface différente

Outre la console Amazon EMR, vous pouvez gérer Amazon EMR à l'aide de l'API du AWS Command Line Interface service Web ou de l'une des nombreuses API prises en charge. AWS SDKs Pour de plus amples informations, veuillez consulter Interfaces de gestion.

Vous pouvez également interagir avec les applications installées sur les clusters Amazon EMR de plusieurs façons. Certaines applications, comme Apache Hadoop, publient des interfaces web que vous pouvez consulter. Pour de plus amples informations, veuillez consulter Affichage des interfaces Web hébergées sur des clusters Amazon EMR.