Les traductions sont fournies par des outils de traduction automatique. En cas de conflit entre le contenu d'une traduction et celui de la version originale en anglais, la version anglaise prévaudra.

Capacité 4. Fournir un accès, une utilisation et une mise en œuvre sécurisés pour la personnalisation des modèles d'IA générative

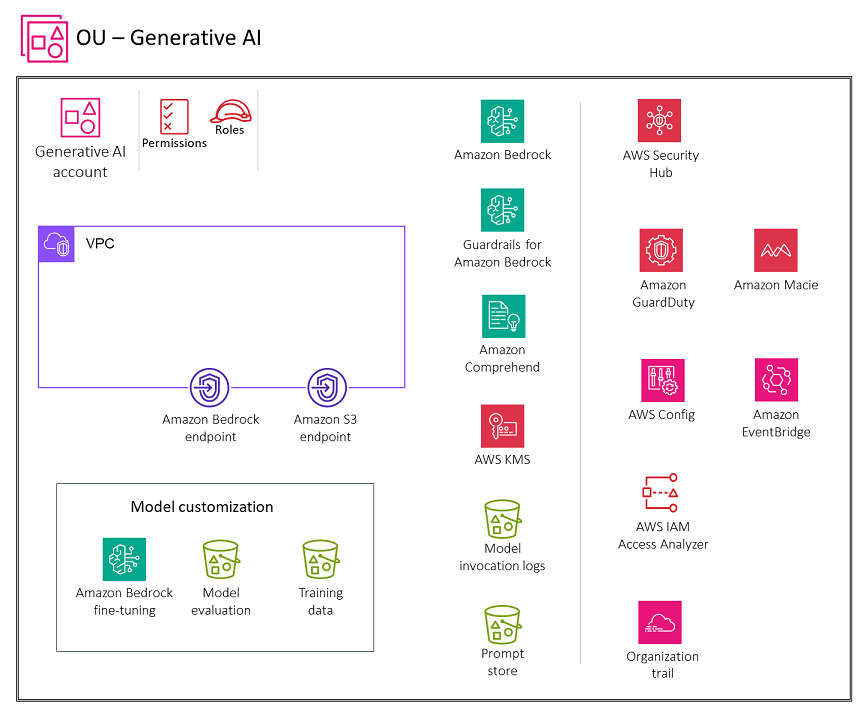

Le schéma suivant illustre les AWS services recommandés pour le compte Generative AI pour cette fonctionnalité. Le but de ce scénario est de sécuriser la personnalisation du modèle. Ce cas d'utilisation se concentre sur la sécurisation des ressources et de l'environnement de formation pour une tâche de personnalisation de modèle ainsi que sur la sécurisation de l'invocation d'un modèle personnalisé.

Le compte Generative AI inclut les services nécessaires à la personnalisation d'un modèle ainsi qu'une suite de services de sécurité requis pour mettre en œuvre des garde-fous et une gouvernance de sécurité centralisée. Vous devez créer des points de terminaison de passerelle Amazon S3 pour les données d'entraînement et les compartiments d'évaluation dans Amazon S3 auxquels un VPC environnement privé est configuré pour accéder afin de permettre la personnalisation du modèle privé.

Justification

La personnalisation du modèle est le processus qui consiste à fournir des données d'entraînement à un modèle afin d'améliorer ses performances pour des cas d'utilisation spécifiques. Dans Amazon Bedrock, vous pouvez personnaliser les modèles de base Amazon Bedrock (FMs) afin d'améliorer leurs performances et de créer une meilleure expérience client en utilisant des méthodes telles que la formation préalable continue avec des données non étiquetées pour améliorer la connaissance du domaine, et le réglage précis avec des données étiquetées pour optimiser les performances spécifiques aux tâches. Si vous personnalisez un modèle, vous devez acheter Provisioned Throughput pour pouvoir l'utiliser.

Ce cas d'utilisation fait référence à la portée 4 de la matrice de cadrage de la sécurité de l'IA générative

Vous pouvez également créer un modèle personnalisé dans Amazon Bedrock en utilisant la fonction d'importation de modèles personnalisés pour importer le modèle FMs que vous avez personnalisé dans d'autres environnements, tels qu'Amazon SageMaker. Pour la source d'importation, nous vous recommandons vivement d'utiliser Safetensors pour le format de sérialisation du modèle importé. Contrairement à Pickle, Safetensors vous permet de stocker uniquement des données tensorielles, et non des objets Python arbitraires. Cela élimine les vulnérabilités liées au décryptage de données non fiables. Safetensors ne peut pas exécuter de code : il ne fait que stocker et charger les tenseurs en toute sécurité.

Lorsque vous autorisez les utilisateurs à personnaliser des modèles d'IA générative dans Amazon Bedrock, vous devez tenir compte des principales considérations de sécurité suivantes :

-

Accès sécurisé aux modèles d'invocation, aux tâches de formation et aux fichiers de formation et de validation

-

Chiffrement de la tâche du modèle de formation, du modèle personnalisé et des fichiers de formation et de validation

-

Alertes relatives aux risques de sécurité potentiels, tels que les demandes de jailbreak ou les informations sensibles contenues dans les fichiers de formation

Les sections suivantes abordent ces considérations de sécurité et les fonctionnalités génératives de l'IA.

Personnalisation du modèle Amazon Bedrock

Vous pouvez personnaliser les modèles de base (FMs) de manière privée et sécurisée avec vos propres données dans Amazon Bedrock afin de créer des applications spécifiques à votre domaine, à votre organisation et à votre cas d'utilisation. Grâce à un réglage précis, vous pouvez augmenter la précision du modèle en fournissant votre propre jeu de données d'entraînement étiqueté spécifique à une tâche et en spécialisant davantage votre. FMs Grâce à une formation préalable continue, vous pouvez entraîner des modèles en utilisant vos propres données non étiquetées dans un environnement sécurisé et géré avec des clés gérées par le client. Pour plus d'informations, consultez la section Modèles personnalisés dans la documentation Amazon Bedrock.

Considérations sur la sécurité

Les charges de travail de personnalisation générative des modèles d'IA sont confrontées à des risques uniques, notamment l'exfiltration des données d'entraînement, l'empoisonnement des données par l'injection d'instructions malveillantes ou de logiciels malveillants dans les données de formation, et l'injection ou l'exfiltration rapides de données par des acteurs malveillants lors de l'inférence du modèle. Dans Amazon Bedrock, la personnalisation des modèles offre des contrôles de sécurité robustes pour la protection des données, le contrôle d'accès, la sécurité du réseau, la journalisation et la surveillance, ainsi que la validation des entrées/sorties qui peuvent contribuer à atténuer ces risques.

Assainissements

Protection des données

Chiffrez la tâche de personnalisation du modèle, les fichiers de sortie (mesures de formation et de validation) de la tâche de personnalisation du modèle et le modèle personnalisé qui en résulte à l'aide d'une clé gérée par le client AWS KMS que vous créez, possédez et gérez. Lorsque vous utilisez Amazon Bedrock pour exécuter une tâche de personnalisation de modèle, vous stockez les fichiers d'entrée (données d'entraînement et de validation) dans votre compartiment S3. Lorsque la tâche est terminée, Amazon Bedrock stocke les fichiers de mesures de sortie dans le compartiment S3 que vous avez spécifié lors de la création de la tâche, et stocke les artefacts du modèle personnalisé qui en résultent dans un compartiment S3 contrôlé parAWS. Par défaut, les fichiers d'entrée et de sortie sont chiffrés avec le chiffrement côté serveur Amazon SSE S3 -S3 à l'aide d'une AWS clé gérée. Vous pouvez également choisir de chiffrer ces fichiers à l'aide d'une clé gérée par le client.

Gestion des identités et des accès

Créez un rôle de service personnalisé pour la personnalisation ou l'importation de modèles en respectant le principe du moindre privilège. Pour le rôle de service de personnalisation des modèles, créez une relation de confiance qui permet à Amazon Bedrock d'assumer ce rôle et de réaliser la tâche de personnalisation des modèles. Joignez une politique pour autoriser le rôle à accéder à vos données de formation et de validation ainsi qu'au bucket dans lequel vous souhaitez écrire vos données de sortie. Pour le rôle de service d'importation de modèles, créez une relation de confiance qui permet à Amazon Bedrock d'assumer ce rôle et de réaliser la tâche d'importation de modèles. Joignez une politique pour autoriser le rôle à accéder aux fichiers de modèles personnalisés de votre compartiment S3. Si votre tâche de personnalisation de modèle s'exécute dans unVPC, associez VPC des autorisations à un rôle de personnalisation de modèle.

Sécurité du réseau

Pour contrôler l'accès à vos données, utilisez un cloud privé virtuel (VPC) avec AmazonVPC. Lorsque vous créez votreVPC, nous vous recommandons d'utiliser les DNS paramètres par défaut de la table de routage de votre point de terminaison, afin que la résolution standard d'Amazon S3 soit URLs résolue.

Si vous configurez votre VPC modèle sans accès à Internet, vous devez créer un point de VPCterminaison Amazon S3 pour permettre aux tâches de personnalisation de votre modèle d'accéder aux compartiments S3 qui stockent vos données de formation et de validation et qui stockeront les artefacts du modèle.

Une fois que vous avez terminé de configurer votre terminal VPC et votre terminal, vous devez associer des autorisations au IAMrôle de personnalisation de votre modèle. Après avoir configuré les rôles VPC et autorisations requis, vous pouvez créer une tâche de personnalisation du modèle qui les utilise VPC. En créant un appareil VPC sans accès à Internet avec un point de VPC terminaison S3 associé pour les données d'entraînement, vous pouvez exécuter votre tâche de personnalisation du modèle avec une connectivité privée (sans aucune exposition à Internet).

AWSServices recommandés

Amazon S3

Lorsque vous exécutez une tâche de personnalisation de modèle, la tâche accède à votre compartiment S3 pour télécharger les données d'entrée et les métriques de la tâche. Vous pouvez choisir le réglage fin ou le pré-entraînement continu comme type de modèle lorsque vous soumettez votre travail de personnalisation de modèle sur la console Amazon Bedrock ou. API Une fois la tâche de personnalisation du modèle terminée, vous pouvez analyser les résultats du processus de formation en consultant les fichiers du compartiment S3 de sortie que vous avez spécifié lorsque vous avez soumis la tâche, ou en consultant les détails du modèle. Chiffrez les deux compartiments avec une clé gérée par le client. Pour renforcer davantage la sécurité du réseau, vous pouvez créer un point de terminaison de passerelle pour les compartiments S3 auxquels l'VPCenvironnement est configuré pour accéder. Les accès doivent être enregistrés et surveillés. Utilisez le versionnement pour les sauvegardes. Vous pouvez utiliser des politiques basées sur les ressources pour contrôler plus étroitement l'accès à vos fichiers Amazon S3.

Amazon Macie

Macie peut vous aider à identifier les données sensibles dans vos ensembles de données de formation et de validation Amazon S3. Pour connaître les meilleures pratiques en matière de sécurité, consultez la section précédente consacrée à Macie dans ce guide.

Amazon EventBridge

Vous pouvez utiliser Amazon EventBridge pour configurer Amazon afin qu'il SageMaker réponde automatiquement à un changement de statut de tâche lié à la personnalisation d'un modèle dans Amazon Bedrock. Les événements d'Amazon Bedrock sont transmis à Amazon EventBridge quasiment en temps réel. Vous pouvez écrire des règles simples pour automatiser les actions lorsqu'un événement correspond à une règle.

AWS KMS

Nous vous recommandons d'utiliser une clé gérée par le client pour chiffrer la tâche de personnalisation du modèle, les fichiers de sortie (métriques de formation et de validation) de la tâche de personnalisation du modèle, le modèle personnalisé obtenu et les compartiments S3 qui hébergent les données d'entraînement, de validation et de sortie. Pour plus d'informations, consultez la section Chiffrement des tâches et artefacts de personnalisation des modèles dans la documentation Amazon Bedrock.

Une politique clé est une politique de ressources pour une AWS KMS clé. Les politiques clés constituent le principal moyen de contrôler l'accès aux KMS clés. Vous pouvez également utiliser des IAM politiques et des autorisations pour contrôler l'accès aux KMS clés, mais chaque KMS clé doit être associée à une politique clé. Utilisez une politique de clé pour autoriser un rôle à accéder au modèle personnalisé chiffré à l'aide de la clé gérée par le client. Cela permet aux rôles spécifiés d'utiliser un modèle personnalisé pour l'inférence.

Utilisez Amazon CloudWatch, Amazon CloudTrail, Amazon OpenSearch Serverless, Amazon S3 et Amazon Comprehend comme expliqué dans les sections précédentes sur les fonctionnalités.