Les traductions sont fournies par des outils de traduction automatique. En cas de conflit entre le contenu d'une traduction et celui de la version originale en anglais, la version anglaise prévaudra.

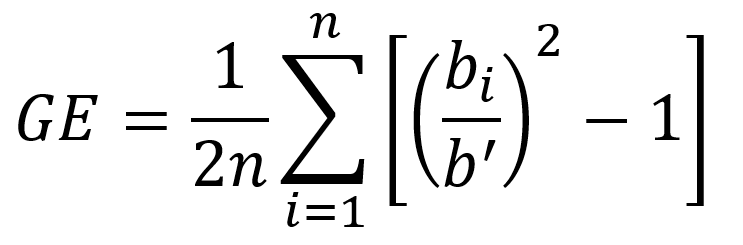

Entropie généralisée (GE)

L'indice d'entropie généralisée (GE) mesure l'inégalité du bénéfice b pour l'étiquette prédite par rapport à l'étiquette observée. Un bénéfice survient lorsqu'un faux positif est prédit. Un faux positif survient quand une observation négative (y=0) a une prédiction positive (y'=1). Un bénéfice survient également lorsque les étiquettes observées et prédites sont les mêmes, à savoir pour un vrai positif et pour un vrai négatif. Aucun bénéfice n'apparaît quand un faux négatif est prédit. Un faux négatif survient dans le cas d'une observation positive (y=1) alors qu'un résultat négatif (y'=0) est prédit. Le bénéfice b est défini comme suit.

b = y' - y + 1

Selon cette définition, un faux positif reçoit un bénéfice b de 2, et un faux négatif reçoit un bénéfice de 0. Un vrai positif et un vrai négatif reçoivent tous les deux un bénéfice de 1.

La métrique GE est calculée comme l'indice d'entropie généraliséealpha défini sur 2. Ce poids contrôle la sensibilité à différentes valeurs de bénéfice. Une plus petite valeur alpha signifie une sensibilité accrue à des valeurs plus faibles.

Les variables suivantes utilisées pour calculer GE sont définies comme suit :

-

bi est le bénéfice reçu par le point de données

ith. -

b' est la moyenne de tous les bénéfices.

GE peut aller de 0 à 0,5, la valeur zéro indiquant l'absence d'inégalité entre les bénéfices de tous les points de données. Cela se produit quand toutes les entrées sont correctement prédites ou quand toutes les prédictions sont des faux positifs. La valeur GE n'est pas définie quand toutes les prédictions sont des faux négatifs.

Note

La métrique GE ne dépend pas du fait qu'une valeur de facette soit favorisée ou défavorisée.