Setelah mempertimbangkan dengan cermat, kami memutuskan untuk menghentikan Amazon Kinesis Data Analytics untuk aplikasi SQL:

1. Mulai 1 September 2025, kami tidak akan memberikan perbaikan bug untuk Amazon Kinesis Data Analytics untuk aplikasi SQL karena kami akan memiliki dukungan terbatas untuk itu, mengingat penghentian yang akan datang.

2. Mulai 15 Oktober 2025, Anda tidak akan dapat membuat Kinesis Data Analytics baru untuk aplikasi SQL.

3. Kami akan menghapus aplikasi Anda mulai 27 Januari 2026. Anda tidak akan dapat memulai atau mengoperasikan Amazon Kinesis Data Analytics untuk aplikasi SQL. Support tidak akan lagi tersedia untuk Amazon Kinesis Data Analytics untuk SQL sejak saat itu. Untuk informasi selengkapnya, lihat Amazon Kinesis Data Analytics untuk penghentian Aplikasi SQL.

Terjemahan disediakan oleh mesin penerjemah. Jika konten terjemahan yang diberikan bertentangan dengan versi bahasa Inggris aslinya, utamakan versi bahasa Inggris.

Contoh: Jendela Tumbling Menggunakan Stempel Waktu Peristiwa

Ketika kueri jendela memproses setiap jendela dengan cara yang tidak tumpang tindih, jendela disebut sebagai jendela tumbling. Lihat perinciannya di Jendela Tumbling (Agregasi Menggunakan GROUP BY). Contoh Amazon Kinesis Data Analytics menunjukkan jendela tumbling yang menggunakan stempel waktu peristiwa, yang merupakan stempel waktu yang dibuat pengguna yang disertakan dalam data streaming. Contoh tersebut menggunakan pendekatan ini daripada hanya menggunakan ROWTIME, yang merupakan stempel waktu yang dibuat Kinesis Data Analytics saat aplikasi menerima catatan. Anda akan menggunakan stempel waktu peristiwa dalam data streaming jika Anda ingin membuat agregasi berdasarkan kapan peristiwa terjadi, bukan ketika peristiwa diterima oleh aplikasi. Dalam contoh ini, nilai ROWTIME memicu agregasi setiap menit, dan catatan dikumpulkan oleh kedua ROWTIME dan waktu peristiwa yang disertakan.

Dalam contoh ini, Anda menulis catatan berikut ke Amazon Kinesis stream. Nilai EVENT_TIME sebelumnya diatur ke 5 detik, untuk menyimulasikan keterlambatan pemrosesan dan transmisi yang mungkin membuat penundaan sejak peristiwa terjadi, hingga saat catatan tersebut diserap ke Kinesis Data Analytics.

{"EVENT_TIME": "2018-06-13T14:11:05.766191", "TICKER": "TBV", "PRICE": 43.65} {"EVENT_TIME": "2018-06-13T14:11:05.848967", "TICKER": "AMZN", "PRICE": 35.61} {"EVENT_TIME": "2018-06-13T14:11:05.931871", "TICKER": "MSFT", "PRICE": 73.48} {"EVENT_TIME": "2018-06-13T14:11:06.014845", "TICKER": "AMZN", "PRICE": 18.64} ...

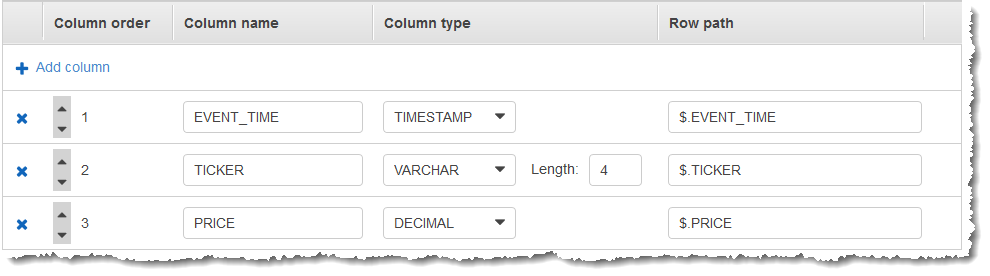

Anda kemudian membuat aplikasi Kinesis Data Analytics Konsol Manajemen AWS di, dengan aliran data Kinesis sebagai sumber streaming. Proses penemuan membaca catatan sampel pada sumber streaming dan menyimpulkan skema dalam aplikasi dengan tiga kolom (EVENT_TIME, TICKER, dan PRICE) seperti yang ditunjukkan berikut ini.

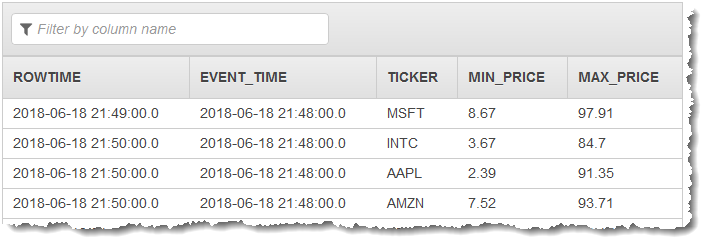

Anda menggunakan kode aplikasi dengan fungsi MIN dan MAX untuk membuat jendela agregasi data. Anda selanjutnya memasukkan data yang dihasilkan ke aliran dalam aplikasi lainnya, seperti yang ditunjukkan dalam tangkapan layar bawah ini:

Dalam prosedur berikut, Anda membuat aplikasi Kinesis Data Analytics yang menggabungkan nilai dalam aliran input di jendela tumbling berdasarkan waktu peristiwa.

Langkah 1: Buat Kinesis Data Stream

Buat Amazon Kinesis data stream dan isi catatan sebagai berikut:

-

Pilih Data Streams (Aliran Data) di panel navigasi.

-

Pilih Create Kinesis stream (Buat Aliran Kinesis), lalu buat aliran dengan satu serpihan. Untuk informasi selengkapnya, lihat Buat Aliran di Panduan Developer Amazon Kinesis Data Streams.

-

Untuk menulis catatan ke Kinesis data stream di lingkungan produksi, sebaiknya gunakan Kinesis Client Library atau API Kinesis Data Streams. Untuk kemudahan, contoh ini menggunakan skrip Python berikut untuk menghasilkan catatan. Jalankan kode untuk mengisi catatan ticker sampel. Kode sederhana ini terus menulis catatan ticker acak ke aliran. Jaga skrip agar tetap berjalan agar Anda dapat menghasilkan skema aplikasi di langkah berikutnya.

import datetime import json import random import boto3 STREAM_NAME = "ExampleInputStream" def get_data(): return { "EVENT_TIME": datetime.datetime.now().isoformat(), "TICKER": random.choice(["AAPL", "AMZN", "MSFT", "INTC", "TBV"]), "PRICE": round(random.random() * 100, 2), } def generate(stream_name, kinesis_client): while True: data = get_data() print(data) kinesis_client.put_record( StreamName=stream_name, Data=json.dumps(data), PartitionKey="partitionkey" ) if __name__ == "__main__": generate(STREAM_NAME, boto3.client("kinesis"))

Langkah 2: Buat Aplikasi Kinesis Data Analytics

Buat aplikasi Amazon Kinesis Data Analytics seperti berikut:

-

Pilih Create application (Buat aplikasi), masukkan nama aplikasi, dan pilih Create application (Buat aplikasi).

-

Pada halaman detail aplikasi, pilih Connect data streaming (Sambungkan data streaming) untuk menyambungkan ke sumber.

-

Di halaman Sambungkan ke sumber, lakukan hal berikut:

-

Pilih aliran yang Anda buat di bagian sebelumnya.

-

Pilih Discover Schema (Temukan Skema). Tunggu hingga konsol menampilkan skema yang disimpulkan dan catatan sampel yang digunakan untuk menyimpulkan skema untuk aliran dalam aplikasi yang dibuat. Skema yang disimpulkan memiliki tiga kolom.

-

Pilih Edit Schema (Edit Skema). Ubah Column type (Tipe kolom) dari kolom EVENT_TIME ke

TIMESTAMP. -

Pilih Save schema and update stream samples (Simpan skema dan perbarui sampel aliran). Setelah konsol menyimpan skema, pilih Exit (Keluar).

-

Jangan pilih Save and continue (Simpan dan lanjutkan).

-

-

Di halaman detail aplikasi, pilih Go to SQL editor (Buka editor SQL). Untuk memulai aplikasi, pilih Yes, start application (Ya, mulai aplikasi) di kotak dialog yang muncul.

-

Di editor SQL, tulis kode aplikasi, dan verifikasi hasilnya sebagai berikut:

-

Salin kode aplikasi berikut dan tempelkan ke editor.

CREATE OR REPLACE STREAM "DESTINATION_SQL_STREAM" (EVENT_TIME timestamp, TICKER VARCHAR(4), min_price REAL, max_price REAL); CREATE OR REPLACE PUMP "STREAM_PUMP" AS INSERT INTO "DESTINATION_SQL_STREAM" SELECT STREAM STEP("SOURCE_SQL_STREAM_001".EVENT_TIME BY INTERVAL '60' SECOND), TICKER, MIN(PRICE) AS MIN_PRICE, MAX(PRICE) AS MAX_PRICE FROM "SOURCE_SQL_STREAM_001" GROUP BY TICKER, STEP("SOURCE_SQL_STREAM_001".ROWTIME BY INTERVAL '60' SECOND), STEP("SOURCE_SQL_STREAM_001".EVENT_TIME BY INTERVAL '60' SECOND); -

Pilih Save and run SQL (Simpan dan jalankan SQL).

Di tab Real-time analytics (Analitik waktu nyata), Anda dapat melihat semua aliran dalam aplikasi yang dibuat aplikasi dan memverifikasi data.

-