Le traduzioni sono generate tramite traduzione automatica. In caso di conflitto tra il contenuto di una traduzione e la versione originale in Inglese, quest'ultima prevarrà.

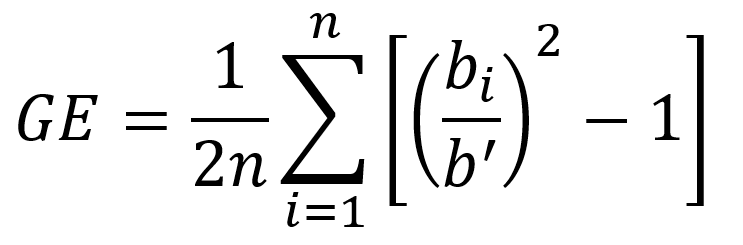

Entropia generalizzata (GE)

L'indice di entropia generalizzato (GE) misura la disuguaglianza in termini di beneficio b per l'etichetta prevista rispetto all'etichetta osservata. Un vantaggio si verifica quando si prevede un falso positivo. Un falso positivo si verifica quando un'osservazione negativa (y=0) ha una previsione positiva (y'=1). Un vantaggio si verifica anche quando le etichette osservate e previste sono le stesse, note anche come vero positivo e vero negativo. Non si ottiene alcun vantaggio quando si prevede un falso negativo. Un falso negativo si verifica quando si prevede che un'osservazione positiva (y=1) abbia un esito negativo (y'=0). Il vantaggio b è definito come segue.

b = y' - y + 1

Utilizzando questa definizione, un falso positivo riceve un vantaggio b di 2 e un falso negativo riceve un vantaggio di 0. Sia un vero positivo sia un vero negativo ricevono un vantaggio di 1.

La metrica GE viene calcolata sulla base del Generalized Entropy Indexalpha impostato su 2. Questo peso controlla la sensibilità ai diversi valori dei benefici. Un valore più piccolo alpha indica una maggiore sensibilità a valori inferiori.

Le seguenti variabili utilizzate per calcolare GE sono definite come segue:

-

bi è il vantaggio ricevuto dal punto dati

ith. -

b' è la media di tutti i benefici.

GE può variare da 0 a 0,5, dove i valori pari a zero indicano l'assenza di disparità nei benefici tra tutti i punti dati. Ciò si verifica quando tutti gli input sono previsti correttamente o quando tutte le previsioni sono falsi positivi. GE non è definito quando tutte le previsioni sono falsi negativi.

Nota

La metrica GE non dipende dal fatto che un valore del facet sia favorito o sfavorito.