Nach reiflicher Überlegung haben wir uns entschieden, Amazon Kinesis Data Analytics für SQL-Anwendungen einzustellen:

1. Ab dem 1. September 2025 werden wir keine Bugfixes für Amazon Kinesis Data Analytics for SQL-Anwendungen bereitstellen, da wir aufgrund der bevorstehenden Einstellung nur eingeschränkten Support dafür haben werden.

2. Ab dem 15. Oktober 2025 können Sie keine neuen Kinesis Data Analytics for SQL-Anwendungen mehr erstellen.

3. Wir werden Ihre Anwendungen ab dem 27. Januar 2026 löschen. Sie können Ihre Amazon Kinesis Data Analytics for SQL-Anwendungen nicht starten oder betreiben. Ab diesem Zeitpunkt ist kein Support mehr für Amazon Kinesis Data Analytics for SQL verfügbar. Weitere Informationen finden Sie unter Einstellung von Amazon Kinesis Data Analytics für SQL-Anwendungen.

Die vorliegende Übersetzung wurde maschinell erstellt. Im Falle eines Konflikts oder eines Widerspruchs zwischen dieser übersetzten Fassung und der englischen Fassung (einschließlich infolge von Verzögerungen bei der Übersetzung) ist die englische Fassung maßgeblich.

Beispiel: Rollierendes Fenster mit ROWTIME

Wenn eine Abfrage mit Fenster jedes Fenster so verarbeitet, dass diese sich nicht überschneiden, wird das Fenster als rollierendes Fenster bezeichnet. Details hierzu finden Sie unter Rollierende Fenster (Zusammenfassungen mit GROUP BY). Dieses Amazon-Kinesis-Data-Analytics-Beispiel erstellt anhand der ROWTIME-Spalte rollierende Fenster. Die ROWTIME-Spalte zeigt den Zeitpunkt an, zu dem der Datensatz von der Anwendung gelesen wurde.

In diesem Beispiel schreiben Sie die folgenden Datensätze in einen Kinesis-Datenstrom.

{"TICKER": "TBV", "PRICE": 33.11} {"TICKER": "INTC", "PRICE": 62.04} {"TICKER": "MSFT", "PRICE": 40.97} {"TICKER": "AMZN", "PRICE": 27.9} ...

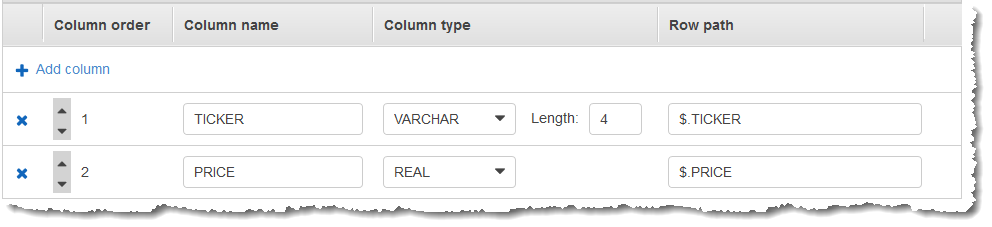

Anschließend erstellen Sie eine Kinesis Data Analytics Analytics-Anwendung in der AWS-Managementkonsole, mit dem Kinesis-Datenstream als Streaming-Quelle. Der Erkennungsvorgang liest Beispieldatensätze aus der Streaming-Quelle und leitet wie nachstehend veranschaulicht ein In-Application-Schema mit zwei Spalten (TICKER und PRICE) ab.

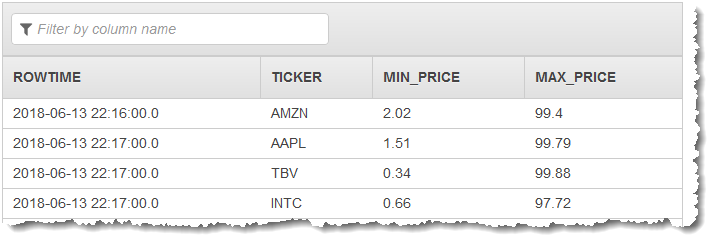

Sie verwenden den Anwendungscode mit den Funktionen MIN und MAX, um eine fensterbasierte Aggregation der Daten zu erstellen. Danach fügen Sie die resultierenden Daten wie im folgenden Screenshot dargestellt in einen anderen In-Application-Stream ein:

Im folgenden Verfahren erstellen Sie eine Kinesis Data Analytics-Anwendung, die Werte im Eingabe-Stream in einem rollierenden Fenster basierend auf ROWTIME aggregiert.

Themen

Schritt 1: Erstellen eines Kinesis-Datenstroms

Erstellen Sie einen Amazon-Kinesis-Datenstrom und füllen Sie die Datensätze wie folgt aus:

Melden Sie sich bei der an AWS-Managementkonsole und öffnen Sie die Kinesis-Konsole unter https://console.aws.amazon.com/kinesis

. -

Klicken Sie im Navigationsbereich auf Data Streams (Daten-Streams).

-

Klicken Sie auf Create Kinesis stream (Kinesis-Stream erstellen) und erstellen Sie dann einen Stream mit einer Shard. Weitere Informationen finden Sie unter Einen Stream erstellen im Amazon-Kinesis-Data-Streams-Entwicklerhandbuch.

-

Um Datensätze an einen Kinesis-Datenstream in einer Produktionsumgebung zu schreiben, empfiehlt sich die Verwendung der Kinesis Client Library oder der API der Kinesis-Daten-Streams. Der Einfachheit halber werden in diesem Beispiel mit dem Python-Skript Datensätze generiert. Führen Sie den Code aus, um die Beispiel-Ticker-Datensätze zu füllen. Dieser einfache Code schreibt kontinuierlich einen zufälligen Ticker-Datensatz an den Stream. Führen Sie das Skript weiter aus, damit Sie das Anwendungsschema später erstellen können.

import datetime import json import random import boto3 STREAM_NAME = "ExampleInputStream" def get_data(): return { "EVENT_TIME": datetime.datetime.now().isoformat(), "TICKER": random.choice(["AAPL", "AMZN", "MSFT", "INTC", "TBV"]), "PRICE": round(random.random() * 100, 2), } def generate(stream_name, kinesis_client): while True: data = get_data() print(data) kinesis_client.put_record( StreamName=stream_name, Data=json.dumps(data), PartitionKey="partitionkey" ) if __name__ == "__main__": generate(STREAM_NAME, boto3.client("kinesis"))

Schritt 2: Erstellen Sie die Amazon-Kinesis-Data-Analytics-Anwendung

Erstellen Sie wie folgt eine Kinesis Data Analytics-Anwendung:

-

Wählen Sie Create application (Anwendung erstellen) aus, geben Sie einen Anwendungsnamen ein und wählen Sie dann Create application (Anwendung erstellen) aus.

-

Wählen Sie auf der Detailseite der Anwendung Connect streaming data (Streaming-Daten verbinden), um eine Verbindung mit der Quelle herzustellen.

-

Gehen Sie auf der Seite Connect to source (Mit Quelle verbinden) wie folgt vor:

-

Wählen Sie den Stream aus, den Sie im vorherigen Abschnitt erstellt haben.

-

Klicken Sie auf Discover schema (Schema erkennen). Warten Sie, bis die Konsole das abgeleitete Schema und die Beispieldatensätze anzeigt, die zum Ableiten des Schemas für den erstellten In-Application-Stream verwendet werden. Das abgeleitete Schema verfügt über zwei Spalten.

-

Wählen Sie Save schema and update stream samples (Schema speichern und Stream-Beispiel aktualiseren). Nachdem die Konsole das Schema gespeichert hat, klicken Sie auf Exit (Beenden).

-

Wählen Sie Save and continue aus.

-

-

Klicken Sie auf der Detailseite der Anwendung auf Go to SQL editor (Gehe zu SQL-Editor). Um die Anwendung zu starten, wählen Sie im angezeigten Dialogfeld Yes, start application (Ja, Anwendung starten) aus.

-

Schreiben Sie im SQL-Editor den Anwendungscode und überprüfen Sie die Ergebnisse wie folgt:

-

Kopieren Sie den folgenden Anwendungscode und fügen Sie diesen in den Editor ein.

CREATE OR REPLACE STREAM "DESTINATION_SQL_STREAM" (TICKER VARCHAR(4), MIN_PRICE REAL, MAX_PRICE REAL); CREATE OR REPLACE PUMP "STREAM_PUMP" AS INSERT INTO "DESTINATION_SQL_STREAM" SELECT STREAM TICKER, MIN(PRICE), MAX(PRICE) FROM "SOURCE_SQL_STREAM_001" GROUP BY TICKER, STEP("SOURCE_SQL_STREAM_001".ROWTIME BY INTERVAL '60' SECOND); -

Klicken Sie auf Save and run SQL (SQL speichern und ausführen).

Auf der Registerkarte Real-time analytics (Echtzeitanalyse) können Sie alle In-Application-Streams sehen, die von der Anwendung erstellt wurden, und die Daten überprüfen.

-