Las traducciones son generadas a través de traducción automática. En caso de conflicto entre la traducción y la version original de inglés, prevalecerá la version en inglés.

Compilador SageMaker de formación de Amazon

importante

Amazon Web Services (AWS) anuncia que no habrá nuevas versiones o versiones de SageMaker Training Compiler. Puede seguir utilizando SageMaker Training Compiler a través de los AWS Deep Learning Containers (DLCs) existentes para SageMaker formación. Es importante tener en cuenta que, si bien los existentes DLCs permanecen accesibles, ya no recibirán parches ni actualizaciones de ellos AWS, de acuerdo con la Política de soporte de AWS Deep Learning Containers Framework.

Utilice Amazon SageMaker Training Compiler para entrenar modelos de aprendizaje profundo (DL) más rápido en instancias de GPU escalables administradas por SageMaker IA.

¿Qué es SageMaker Training Compiler?

State-of-the-art Los modelos de aprendizaje profundo (DL) consisten en redes neuronales complejas de varios niveles con miles de millones de parámetros que la GPU puede tardar miles de horas en entrenarse. La optimización de estos modelos en la infraestructura de entrenamiento requiere un amplio conocimiento de la DL y de la ingeniería de sistemas, lo que supone todo un reto incluso en casos de uso limitados. Si bien existen compiladores de código abierto que optimizan el proceso de entrenamiento en aprendizaje remoto, pueden carecer de la flexibilidad necesaria para integrar marcos de aprendizaje continuo con algunos tipos de hardware, como las instancias de GPU.

SageMaker El compilador de entrenamiento es una capacidad de la SageMaker IA que realiza estas hard-to-implement optimizaciones para reducir el tiempo de entrenamiento en las instancias de GPU. El compilador optimiza los modelos de aprendizaje automático para acelerar el entrenamiento mediante un uso más eficiente de las instancias de GPU de aprendizaje automático (ML) de SageMaker IA. SageMaker El compilador de formación está disponible sin coste adicional en la SageMaker IA y puede ayudar a reducir el tiempo total facturable, ya que acelera el entrenamiento.

SageMaker Training Compiler está integrado en AWS Deep Learning Containers (DLCs). Con el compilador de SageMaker formación habilitado AWS DLCs, puede compilar y optimizar los trabajos de formación en instancias de GPU con cambios mínimos en el código. Incorpore sus modelos de aprendizaje profundo a la SageMaker IA y permita que SageMaker Training Compiler acelere su trabajo de formación en instancias de aprendizaje automático con SageMaker IA para acelerar la computación.

Cómo funciona

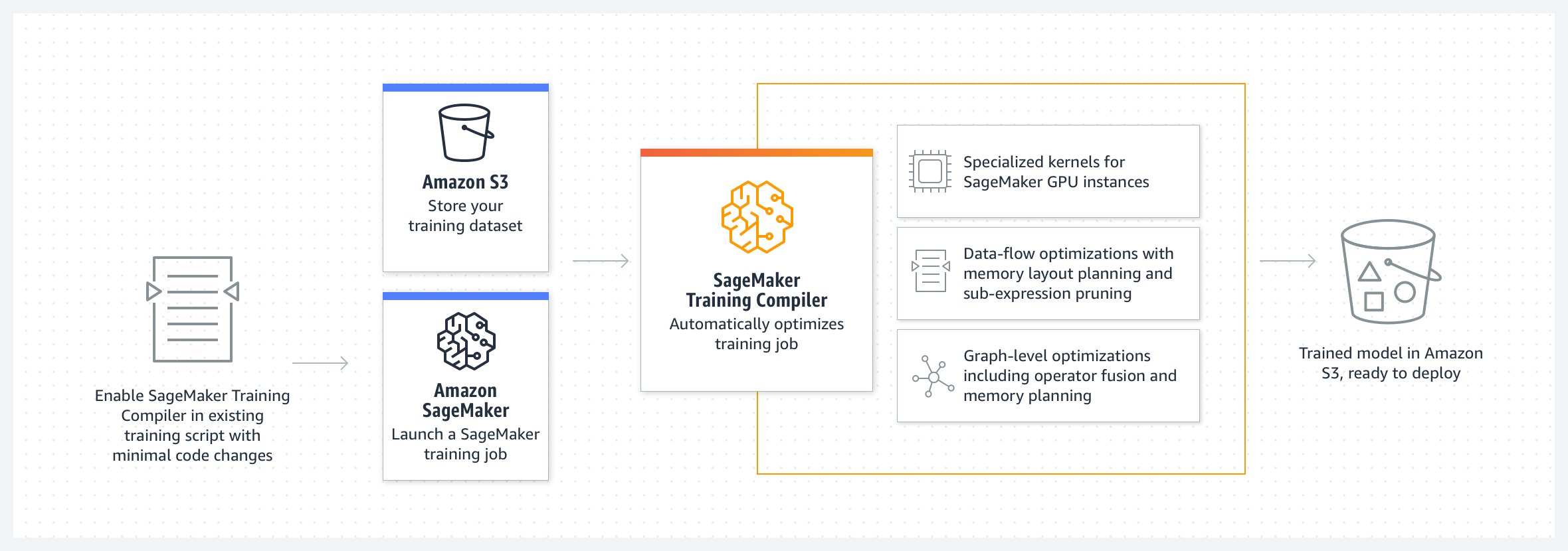

SageMaker Training Compiler convierte los modelos de aprendizaje automático de su representación lingüística de alto nivel en instrucciones optimizadas para el hardware. Específicamente, SageMaker Training Compiler aplica optimizaciones a nivel de gráficos, optimizaciones a nivel de flujo de datos y optimizaciones de backend para producir un modelo optimizado que utilice los recursos de hardware de manera eficiente. Como resultado, puede entrenar sus modelos más rápido que si los entrena sin compilarlos.

La activación de Training Compiler para su trabajo de formación consiste en un proceso de dos pasos: SageMaker

-

Traiga su propio script de aprendizaje continuo y, si es necesario, adáptelo para compilarlo y entrenarlo con SageMaker Training Compiler. Para obtener más información, consulte Usar un modelo de aprendizaje profundo propio.

-

Cree un objeto estimador de SageMaker IA con el parámetro de configuración del compilador mediante el SDK de Python SageMaker .

-

Para activar SageMaker Training Compiler, añádelo

compiler_config=TrainingCompilerConfig()a la clase de estimador de IA SageMaker . -

Ajuste los hiperparámetros (

batch_sizeylearning_rate) para maximizar el beneficio que SageMaker proporciona Training Compiler.La compilación mediante SageMaker Training Compiler cambia el espacio de memoria del modelo. Lo más habitual es que esto se manifieste como una reducción de la utilización de la memoria y el consiguiente aumento del tamaño de lote más grande que cabe en la GPU. En algunos casos, el compilador promueve el almacenamiento en caché de forma inteligente, lo que reduce el tamaño de lote más grande que cabe en la GPU. Tenga en cuenta que si desea cambiar el tamaño del lote, debe ajustar la tasa de entrenamiento de forma adecuada.

Para obtener una referencia sobre los modelos

batch_sizeprobados para los más populares, consulte Modelos probados.Al ajustar el tamaño del lote, también hay que ajustar

learning_rateadecuadamente. Para conocer las prácticas recomendadas para ajustar la tasa de entrenamiento junto con el cambio en el tamaño del lote, consulte SageMaker Recomendaciones y consideraciones sobre Training Compiler. -

Al ejecutar el método de

estimator.fit()clase, la SageMaker IA compila el modelo e inicia el trabajo de formación.

Para obtener instrucciones acerca de cómo iniciar un trabajo de entrenamiento, consulte Habilita el compilador SageMaker de entrenamiento.

-

SageMaker Training Compiler no altera el modelo entrenado final, sino que permite acelerar el trabajo de entrenamiento al utilizar de manera más eficiente la memoria de la GPU y ajustar un tamaño de lote mayor por iteración. El modelo de entrenamiento final del trabajo de entrenamiento acelerado por el compilador es idéntico al del trabajo de entrenamiento normal.

sugerencia

SageMaker Training Compiler solo compila modelos de aprendizaje continuo para entrenarlos en instancias de GPU compatibles administradas por IA. SageMaker Para compilar tu modelo con fines de inferencia e implementarlo para que se ejecute en cualquier lugar de la nube y en la periferia, usa SageMaker el compilador Neo.