Terjemahan disediakan oleh mesin penerjemah. Jika konten terjemahan yang diberikan bertentangan dengan versi bahasa Inggris aslinya, utamakan versi bahasa Inggris.

Konfigurasikan petunjuk lanjutan

Anda dapat mengonfigurasi prompt lanjutan baik di AWS Management Console atau melalui. API

- Console

-

Di konsol, Anda dapat mengonfigurasi petunjuk lanjutan setelah Anda membuat agen. Anda mengonfigurasinya saat mengedit agen.

Untuk melihat atau mengedit petunjuk lanjutan untuk agen Anda

-

Masuk ke AWS Management Console menggunakan IAMperan dengan izin Amazon Bedrock, dan buka konsol Amazon Bedrock di. https://console.aws.amazon.com/bedrock/

-

Di panel navigasi kiri, pilih Agen. Kemudian pilih agen di bagian Agen.

-

Pada halaman detail agen, di bagian Draf kerja, pilih Draf kerja.

-

Pada halaman Draf kerja, di bagian Strategi orkestrasi, pilih Edit.

-

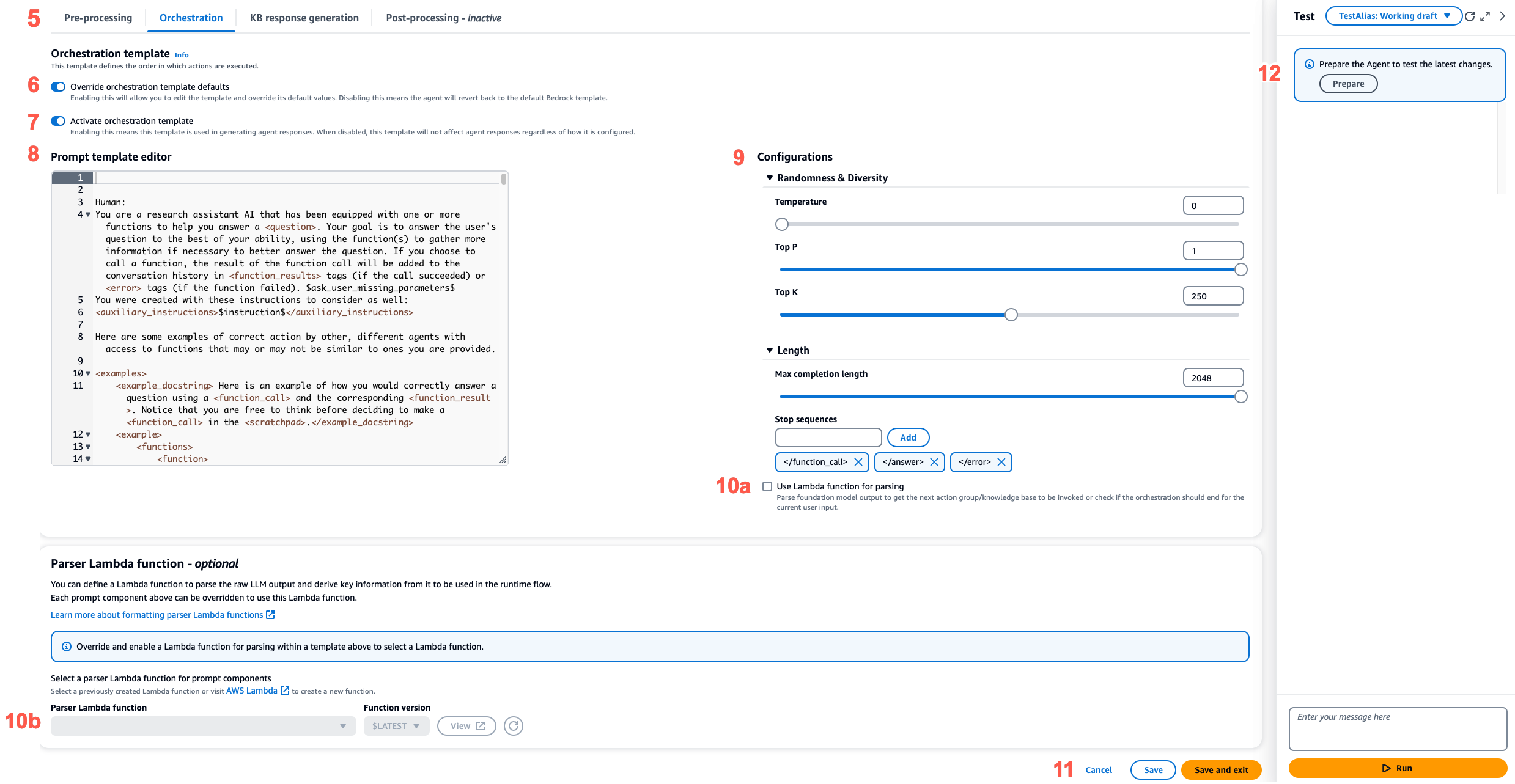

Pada halaman Strategi orkestrasi, di bagian Detail strategi orkestrasi, pastikan orkestrasi Default dipilih dan kemudian pilih tab yang sesuai dengan langkah urutan agen yang ingin Anda edit.

-

Untuk mengaktifkan pengeditan template, aktifkan Override template default. Di kotak dialog Override template default, pilih Konfirmasi.

Awas

Jika Anda menonaktifkan default template Override atau mengubah model, template Amazon Bedrock default digunakan dan template Anda akan segera dihapus. Untuk mengonfirmasi, masukkan

confirmdi kotak teks untuk mengonfirmasi pesan yang muncul. -

Untuk mengizinkan agen menggunakan templat saat menghasilkan respons, aktifkan Aktifkan templat. Jika konfigurasi ini dimatikan, agen tidak menggunakan template.

-

Untuk memodifikasi contoh template prompt, gunakan editor template Prompt.

-

Di Konfigurasi, Anda dapat memodifikasi parameter inferensi untuk prompt. Untuk definisi parameter dan informasi lebih lanjut tentang parameter untuk model yang berbeda, lihatParameter permintaan inferensi dan bidang respons untuk model pondasi.

-

(Opsional) Untuk menggunakan fungsi Lambda yang telah Anda tetapkan untuk mengurai output model dasar mentah, lakukan tindakan berikut:

catatan

Satu fungsi Lambda digunakan untuk semua template prompt.

-

Di bagian Konfigurasi, pilih Gunakan fungsi Lambda untuk penguraian. Jika Anda menghapus pengaturan ini, agen Anda akan menggunakan parser default untuk prompt.

-

Untuk fungsi Parser Lambda, pilih fungsi Lambda dari menu tarik-turun.

catatan

Anda harus melampirkan izin untuk agen Anda sehingga dapat mengakses fungsi Lambda. Untuk informasi selengkapnya, lihat Kebijakan berbasis sumber daya untuk mengizinkan Amazon Bedrock menjalankan fungsi Lambda grup tindakan.

-

-

Untuk menyimpan pengaturan Anda, pilih salah satu opsi berikut:

-

Untuk tetap berada di jendela yang sama sehingga Anda dapat memperbarui pengaturan prompt secara dinamis saat menguji agen Anda yang diperbarui, pilih Simpan.

-

Untuk menyimpan pengaturan Anda dan kembali ke halaman Draf kerja, pilih Simpan dan keluar.

-

-

Untuk menguji pengaturan yang diperbarui, pilih Siapkan di jendela Uji.

-

- API

-

Untuk mengkonfigurasi prompt lanjutan dengan menggunakan API operasi, Anda mengirim UpdateAgentpanggilan dan memodifikasi

promptOverrideConfigurationobjek berikut."promptOverrideConfiguration": { "overrideLambda": "string", "promptConfigurations": [ { "basePromptTemplate": "string", "inferenceConfiguration": { "maximumLength": int, "stopSequences": [ "string" ], "temperature": float, "topK": float, "topP": float }, "parserMode": "DEFAULT | OVERRIDDEN", "promptCreationMode": "DEFAULT | OVERRIDDEN", "promptState": "ENABLED | DISABLED", "promptType": "PRE_PROCESSING | ORCHESTRATION | KNOWLEDGE_BASE_RESPONSE_GENERATION | POST_PROCESSING | MEMORY_SUMMARIZATION" } ], promptCachingState: { cachingState: "ENABLED | DISABLED" } }-

Dalam

promptConfigurationsdaftar, sertakanpromptConfigurationobjek untuk setiap template prompt yang ingin Anda edit. -

Tentukan prompt untuk memodifikasi di

promptTypebidang. -

Ubah templat prompt melalui langkah-langkah berikut:

-

Tentukan

basePromptTemplatebidang dengan templat prompt Anda. -

Sertakan parameter inferensi dalam

inferenceConfigurationobjek. Untuk informasi selengkapnya tentang konfigurasi inferensi, lihat. Parameter permintaan inferensi dan bidang respons untuk model pondasi

-

-

Untuk mengaktifkan template prompt, atur

promptCreationModekeOVERRIDDEN. -

Untuk mengizinkan atau mencegah agen melakukan langkah di

promptTypelapangan, ubahpromptStatenilainya. Pengaturan ini dapat berguna untuk memecahkan masalah perilaku agen.-

Jika Anda mengatur

promptStateDISABLEDuntukPRE_PROCESSING,KNOWLEDGE_BASE_RESPONSE_GENERATION, atauPOST_PROCESSINGlangkah-langkah, agen melewatkan langkah itu. -

Jika Anda mengatur

promptStateDISABLEDuntukORCHESTRATIONlangkah tersebut, agen hanya mengirimkan input pengguna ke model foundation dalam orkestrasi. Selain itu, agen mengembalikan respons apa adanya tanpa mengatur panggilan antara API operasi dan basis pengetahuan. -

Secara default,

POST_PROCESSINGlangkahnya adalahDISABLED. Secara default,,PRE_PROCESSINGORCHESTRATION, danKNOWLEDGE_BASE_RESPONSE_GENERATIONlangkah-langkahnya adalahENABLED. -

Secara default,

MEMORY_SUMMARIZATIONlangkahnya adalahENABLEDjika Memori diaktifkan danMEMORY_SUMMARIZATIONlangkahnya adalahDISABLEDjika Memori dinonaktifkan.

-

-

Untuk menggunakan fungsi Lambda yang telah Anda tentukan untuk mengurai keluaran model dasar mentah, lakukan langkah-langkah berikut:

-

Untuk setiap templat prompt yang ingin Anda aktifkan fungsi Lambda, atur

parserModeke.OVERRIDDEN -

Tentukan Amazon Resource Name (ARN) dari fungsi Lambda di

overrideLambdabidang di objek.promptOverrideConfiguration

-

-

(Opsional) Untuk mengaktifkan caching cepat untuk mengurangi latensi saat Anda memiliki input dengan konteks yang panjang dan berulang, setel bidang ke

cachingState.ENABLEDUntuk informasi selengkapnya tentang caching cepat, lihatCaching cepat untuk inferensi model yang lebih cepat.catatan

Amazon Bedrock prompt caching saat ini hanya tersedia untuk sejumlah pelanggan tertentu. Untuk mempelajari lebih lanjut tentang berpartisipasi dalam pratinjau, lihat caching prompt Amazon Bedrock

.

-