本文為英文版的機器翻譯版本,如內容有任何歧義或不一致之處,概以英文版為準。

演算法的運作方式 SageMaker XGBoost

XGBoost

使用梯度提升進行

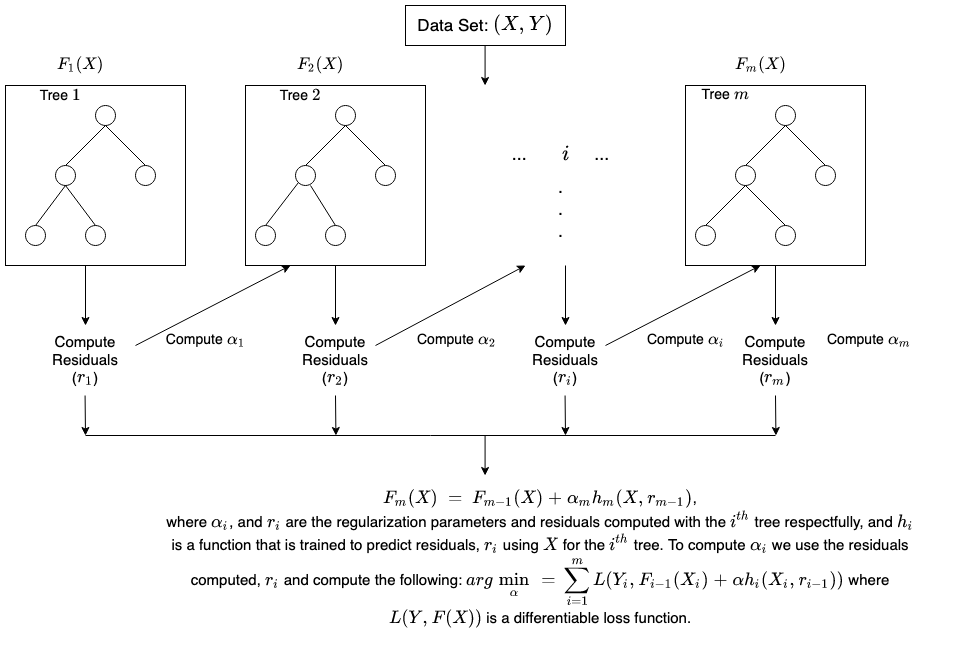

下面是關於梯度樹提升如何運作的簡要說明。

如需 的詳細資訊XGBoost,請參閱:

本文為英文版的機器翻譯版本,如內容有任何歧義或不一致之處,概以英文版為準。

XGBoost

使用梯度提升進行

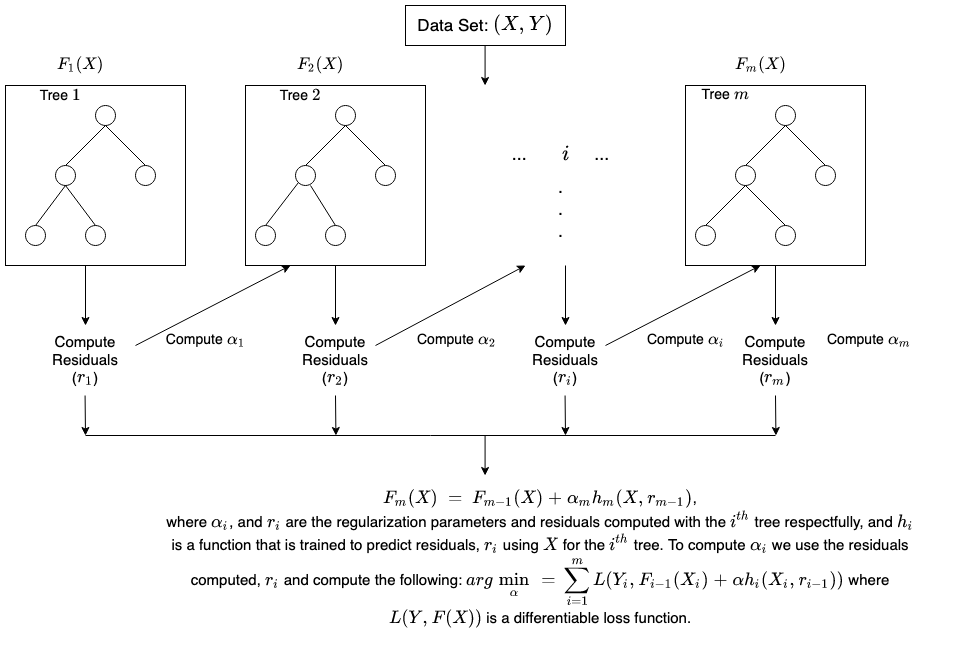

下面是關於梯度樹提升如何運作的簡要說明。

如需 的詳細資訊XGBoost,請參閱: