Las traducciones son generadas a través de traducción automática. En caso de conflicto entre la traducción y la version original de inglés, prevalecerá la version en inglés.

| Para el archivado y el análisis de eventos, Amazon SNS recomienda ahora utilizar su integración nativa con Amazon Data Firehose. Puede suscribir las transmisiones de entrega de Firehose a temas de SNS, lo que le permite enviar notificaciones a puntos de enlace de archivado y análisis, como depósitos de Amazon Simple Storage Service (Amazon S3), tablas de Amazon Redshift, Amazon Service (Service) y más. OpenSearch OpenSearch El uso de Amazon SNS con las transmisiones de entrega de Firehose es una solución totalmente gestionada y sin código que no requiere el uso de funciones. AWS Lambda Para obtener más información, consulte Distribución ramificada a los flujos de entrega de Firehose. |

Puede usar Amazon SNS para crear aplicaciones basadas en eventos que utilicen los servicios de suscriptor para realizar trabajos de manera automática en respuesta a eventos desencadenados por los servicios de publicador. Este patrón arquitectónico puede hacer que los servicios sean más reutilizables, interoperables y escalables. Sin embargo, puede ser muy laborioso bifurcar el procesamiento de eventos a canalizaciones que cumplan los requisitos comunes de administración de eventos, como el almacenamiento, la copia de seguridad, la búsqueda, el análisis y la reproducción de eventos.

Para acelerar el desarrollo de sus aplicaciones basadas en eventos, puede suscribir canales de gestión de eventos (impulsados por Event Fork AWS Pipelines) a los temas de Amazon SNS. AWS Event Fork Pipelines es un conjunto de aplicaciones anidadas de código abierto, basadas en el modelo de aplicaciones AWS sin servidor

Para ver un AWS caso de uso de Event Fork Pipelines, consulte. Implementación y prueba de la aplicación de ejemplo de canalizaciones de bifurcación de eventos de Amazon SNS

Temas

Cómo funciona AWS Event Fork Pipelines

AWS Event Fork Pipelines es un patrón de diseño sin servidor. Sin embargo, también es un conjunto de aplicaciones anidadas sin servidor basadas en AWS SAM (que puede implementar directamente desde el AWS Serverless Application Repository (AWS SAR) al suyo para enriquecer sus Cuenta de AWS plataformas basadas en eventos). Puede implementar estas aplicaciones anidadas de forma individual, según lo requiera su arquitectura.

Temas

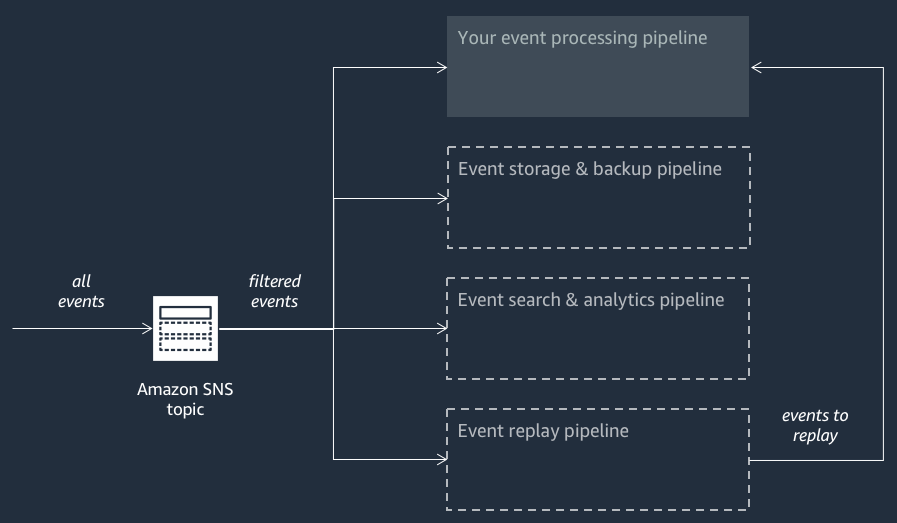

El siguiente diagrama muestra una aplicación AWS Event Fork Pipelines complementada con tres aplicaciones anidadas. Puede implementar cualquiera de las canalizaciones del paquete AWS Event Fork Pipelines en el AWS SAR de forma independiente, según lo requiera su arquitectura.

Cada canalización está suscrita al mismo tema de Amazon SNS, lo que le permite procesar eventos en paralelo a medida que se publican en el tema. Cada canalización es independiente y puede establecer su propia política de filtros de suscripción. De este modo, una canalización puede procesar solo un subconjunto de los eventos que le interesan (en lugar de todos los eventos publicados en el tema).

nota

Como colocas las tres canalizaciones de AWS Event Fork junto a las canalizaciones de procesamiento de eventos habituales (es posible que ya estés suscrito a tu tema de Amazon SNS), no necesitas cambiar ninguna parte de tu editor de mensajes actual para aprovechar las canalizaciones de AWS Event Fork en tus cargas de trabajo actuales.

Canalización de almacenamiento y copia de seguridad de eventos

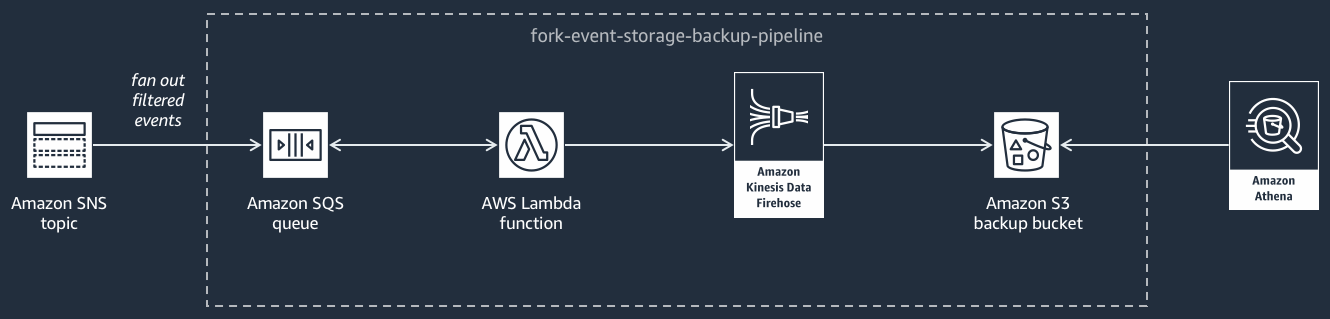

En el siguiente diagrama se muestra la canalización de almacenamiento y copia de seguridad de eventos

Esta canalización se compone de una cola de Amazon SQS que almacena en búfer los eventos publicados por el tema de Amazon SNS, una AWS Lambda función que sondea automáticamente estos eventos de la cola y los envía a una transmisión de Amazon Data Firehose y un depósito de Amazon S3 que realiza copias de seguridad duraderas de los eventos cargados por la transmisión.

Para optimizar el comportamiento del flujo de Firehose, puede configurarlo para que almacene en búfer, transforme y comprima los eventos antes de cargarlos en el bucket. A medida que se carguen los eventos, puede utilizar Amazon Athena para consultar el bucket mediante consultas de SQL estándar. También puede configurar la canalización para reutilizar un bucket de Amazon S3 existente o crear uno nuevo.

Canalización de búsqueda y análisis de eventos

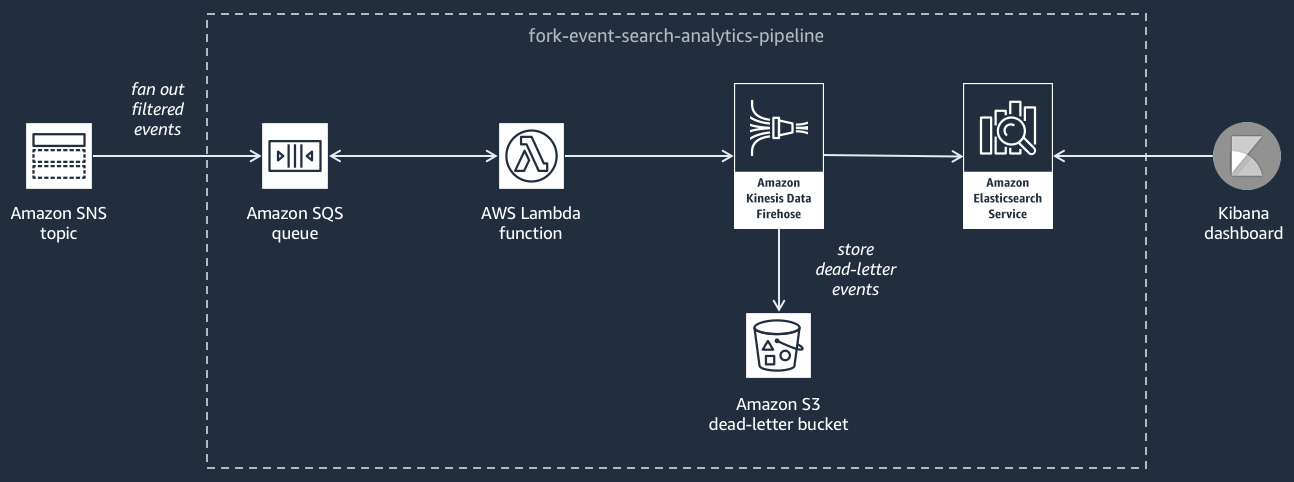

En el siguiente diagrama se muestra la canalización de búsqueda y análisis de eventos

Esta canalización se compone de una cola de Amazon SQS que almacena en búfer los eventos publicados por el tema de Amazon SNS, una AWS Lambda función que sondea los eventos de la cola y los envía a una transmisión de Amazon Data Firehose, un OpenSearch dominio de Amazon Service que indexa los eventos cargados por la transmisión de Firehose y un depósito de Amazon S3 que almacena los eventos con letra muerta que no se pueden indexar en el dominio de búsqueda.

Si desea ajustar el flujo de Firehose en cuanto al almacenamiento en búfer, la transformación y la compresión de eventos, puede configurar esta canalización.

También puedes configurar si la canalización debe reutilizar un OpenSearch dominio existente en el tuyo Cuenta de AWS o crear uno nuevo para ti. A medida que los eventos se indexan en el dominio de búsqueda, puede utilizar Kibana para ejecutar análisis de sus eventos y actualizar los paneles visuales en tiempo real.

Canalización de reproducción de eventos

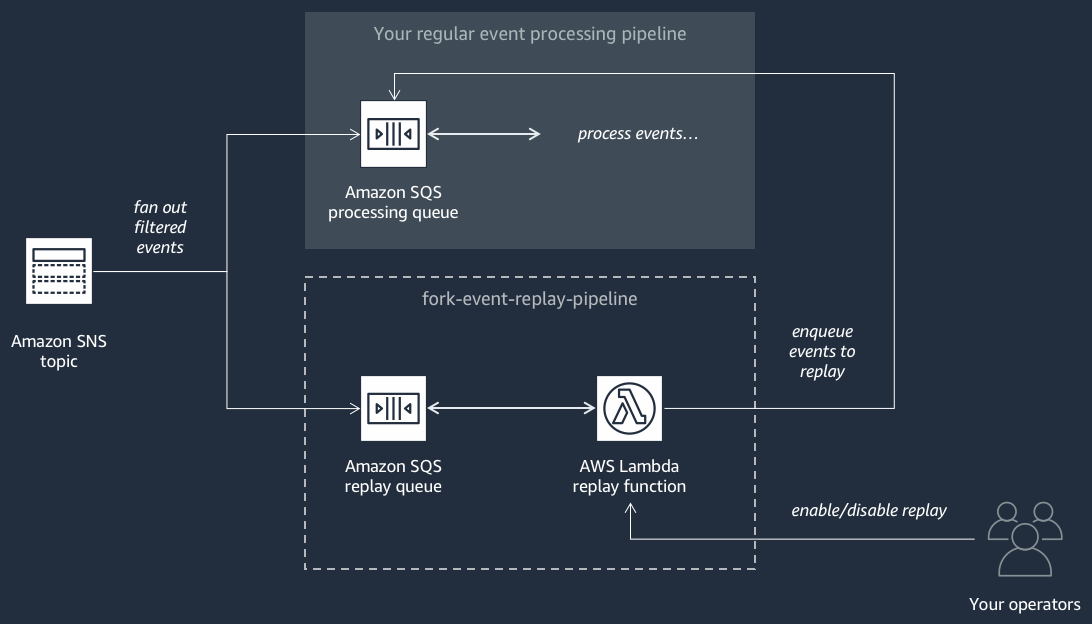

En el siguiente diagrama se muestra la canalización de reproducción de eventos

Esta canalización está compuesta por una cola de Amazon SQS que almacena en búfer los eventos publicados por el tema de Amazon SNS y una AWS Lambda función que sondea los eventos de la cola y los redirige a su canalización de procesamiento de eventos normal, que también está suscrita a su tema.

nota

De forma predeterminada, la característica de reproducción está deshabilitada, por lo que los eventos no se redireccionan. Si necesita volver a procesar los eventos, debe habilitar la cola de reproducción de Amazon SQS como fuente de eventos para la característica de reproducción de AWS Lambda .

Implementación de Event Fork Pipelines AWS

La suite AWS Event Fork Pipelines

En un escenario de producción, recomendamos incrustar AWS Event Fork Pipelines en la plantilla SAM general de AWS la aplicación. La función de aplicación anidada le permite hacerlo añadiendo el recurso AWS::Serverless::Application a su plantilla de AWS SAM, haciendo referencia al AWS SAR ApplicationId y al de la aplicación anidada. SemanticVersion

Por ejemplo, puedes usar Event Storage and Backup Pipeline como una aplicación anidada añadiendo el siguiente fragmento de código YAML a la Resources sección de tu plantilla SAM. AWS

Backup:

Type: AWS::Serverless::Application

Properties:

Location:

ApplicationId: arn:aws:serverlessrepo:us-east-2:123456789012:applications/fork-event-storage-backup-pipeline

SemanticVersion: 1.0.0

Parameters:

#The ARN of the Amazon SNS topic whose messages should be backed up to the Amazon S3 bucket.

TopicArn: !Ref MySNSTopicAl especificar los valores de los parámetros, puede utilizar funciones AWS CloudFormation intrínsecas para hacer referencia a otros recursos de la plantilla. Por ejemplo, en el fragmento de código YAML anterior, el TopicArn parámetro hace referencia al AWS::SNS::Topic recursoMySNSTopic, definido en otra parte de la plantilla. AWS SAM Para obtener más información, consulte la Referencia de funciones intrínsecas en la Guía del usuario de AWS CloudFormation .

nota

La página de la AWS Lambda consola de la aplicación AWS SAR incluye el botón Copiar como recurso SAM, que copia en el portapapeles el YAML necesario para anidar una aplicación AWS SAR.