翻訳は機械翻訳により提供されています。提供された翻訳内容と英語版の間で齟齬、不一致または矛盾がある場合、英語版が優先します。

Amazon SageMaker Data Wrangler で ML データを準備する

重要

Amazon SageMaker Data Wrangler は、Amazon SageMaker Canvas に統合されました。SageMaker Canvas の新しい Data Wrangler エクスペリエンスでは、ビジュアルインターフェイスに加え、自然言語インターフェイスを使用して、データを探索して変換できます。SageMaker Canvas 内の Data Wrangler の詳細については、「データ準備」を参照してください。

Amazon SageMaker Data Wrangler (Data Wrangler) は、データのインポート、準備、変換、特徴量化、分析のエンドツーエンドのソリューションを提供する Amazon SageMaker Studio Classic の機能です。Data Wrangler データ準備フローを機械学習 (ML) ワークフローに統合して、コーディングをほとんどまたはまったく使わずにデータの前処理と特徴量エンジニアリングを簡素化および合理化できます。独自の Python スクリプトと変換を追加してワークフローをカスタマイズすることもできます。

Data Wrangler は、機械学習アプリケーションのためのデータ分析および準備に役立つ以下のコア機能を提供します。

-

インポート – Amazon Simple Storage Service (Amazon S3)、 Amazon Athena (Athena)、Amazon Redshift、Snowflake、Databricks に接続してデータをインポートします。

-

データフロー - データフローを作成して一連の ML データ準備手順を定義します。フローを使用してさまざまなデータソースのデータセットの結合、データセットに適用する変換の数とタイプの特定、ML パイプラインに統合できるデータ準備ワークフローの定義が可能です。

-

変換 - 文字列、ベクトル、数値データの書式設定ツールなど、標準の変換を使用してデータセットをクリーンアップおよび変換します。テキストや日付/時刻の埋め込み、カテゴリ別エンコーディングなどの変換を使用して、データを特徴化します。

-

データインサイトの生成 – Data Wrangler のデータインサイトと品質レポートにより、データ品質を自動的に検証し、データの異常を検出します。

-

分析 - フローの任意の時点でデータセット内の特徴を分析します。Data Wrangler には、散布図やヒストグラムなどの組み込みのデータ視覚化ツールや、ターゲット漏洩解析やクイックモデリングなどのデータ分析ツールが含まれており、特徴の相関性を理解できます。

-

エクスポート – データ準備ワークフローを別の場所にエクスポートします。以下は場所の例です。

-

Amazon Simple Storage Service (Amazon S3) バケット

-

Amazon SageMaker Pipelines – Pipelines を使用して、モデルのデプロイを自動化します。変換したデータをパイプラインに直接エクスポートできます。

-

Amazon SageMaker Feature Store – 機能とそのデータを一元化されたストアに保存します。

-

Python スクリプト – データとその変換をカスタムワークフロー用の Python スクリプトに保存します。

-

Data Wrangler の使用を始める場合は、「Data Wrangler の開始方法」を参照してください。

重要

Data Wrangler は Jupyter Lab バージョン 1 (JL1) をサポートしなくなりました。最新の機能や更新を利用するには、Jupyter Lab バージョン 3 に更新します。アップグレードの詳細については、「コンソールからアプリケーションの JupyterLab のバージョンを表示および更新する」を参照してください。

重要

このガイドに記載されている情報と手順については、Amazon SageMaker Studio Classic の最新バージョンを使用しています。Studio Classic の最新バージョンへのアップデートの詳細については、「Amazon SageMaker Studio Classic の UI の概要」を参照してください。

Studio Classic バージョン 1.3.0 以降を使用する必要があります。以下の手順を使用して Amazon SageMaker Studio Classic を開くと、実行しているバージョンを確認できます。

Studio Classic を開いてバージョンを確認するには、以下の手順を参照してください。

-

「前提条件」の手順に従って、Amazon SageMaker Studio Classic から Data Wrangler にアクセスします。

-

Studio Classic の起動に使用するユーザーの横にある [Studio を開く] をクリックします。

-

[Studio] を選択します。

-

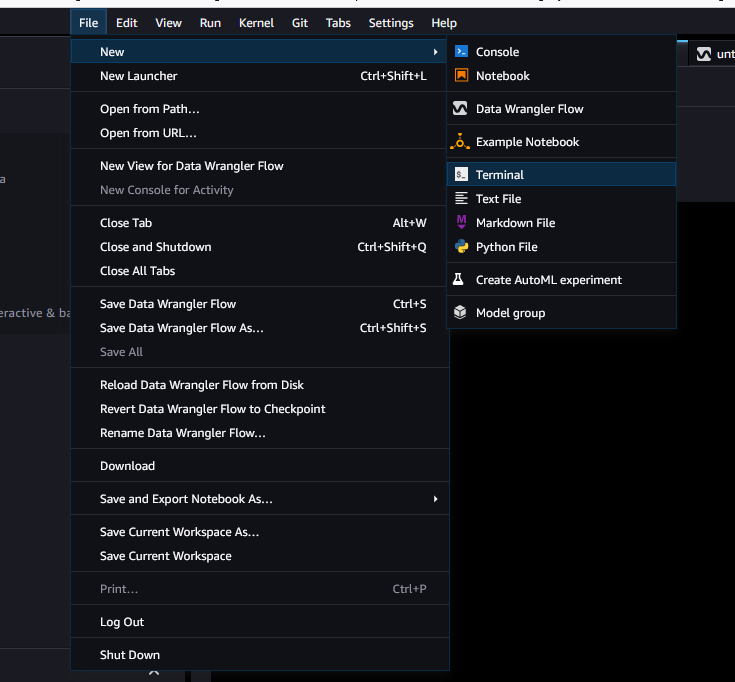

Studio Classic のロード後、[ファイル]、[新規]、[ターミナル] の順に選択します。

-

Studio Classic がロードしたら、[ファイル]、[新規]、[ターミナル] の順に選択します。

-

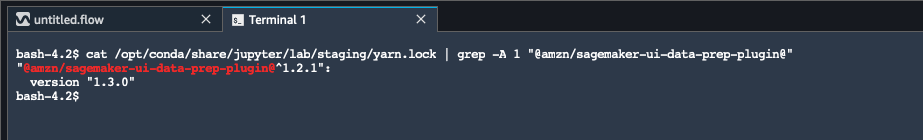

cat /opt/conda/share/jupyter/lab/staging/yarn.lock | grep -A 1 "@amzn/sagemaker-ui-data-prep-plugin@"と入力して、Studio Classic インスタンスのバージョンを印刷します。Snowflake を使用するには、Studio Classic バージョン 1.3.0 以降を使用する必要があります。

Amazon SageMaker Studio Classic は AWS マネジメントコンソール内でアップデートできます。Studio Classic のアップデートの詳細については、「Amazon SageMaker Studio Classic の UI の概要」を参照してください。