Terjemahan disediakan oleh mesin penerjemah. Jika konten terjemahan yang diberikan bertentangan dengan versi bahasa Inggris aslinya, utamakan versi bahasa Inggris.

catatan

Di bagian ini, kami berasumsi bahwa bahasa dan model penyematan yang Anda rencanakan untuk digunakan sudah diterapkan. Untuk model yang disediakan oleh AWS, Anda seharusnya sudah memiliki ARN titik akhir SageMaker AI Anda atau akses ke Amazon Bedrock. Untuk penyedia model lainnya, Anda harus memiliki kunci API yang digunakan untuk mengautentikasi dan mengotorisasi permintaan ke model Anda.

Jupyter AI mendukung berbagai penyedia model dan model bahasa, lihat daftar model yang didukung untuk tetap diperbarui pada model

Konfigurasi Jupyter AI bervariasi tergantung pada apakah Anda menggunakan UI obrolan atau perintah ajaib.

Konfigurasikan penyedia model Anda di UI obrolan

catatan

Anda dapat mengonfigurasi beberapa LLMs dan menyematkan model dengan mengikuti instruksi yang sama. Namun, Anda harus mengkonfigurasi setidaknya satu model Bahasa.

Untuk mengonfigurasi UI obrolan

-

Di JupyterLab, akses antarmuka obrolan dengan memilih ikon obrolan (

) di panel navigasi kiri.

) di panel navigasi kiri. -

Pilih ikon konfigurasi (

) di sudut kanan atas panel kiri. Ini membuka panel konfigurasi Jupyter AI.

) di sudut kanan atas panel kiri. Ini membuka panel konfigurasi Jupyter AI. -

Isi kolom yang terkait dengan penyedia layanan Anda.

-

Untuk model yang disediakan oleh JumpStart atau Amazon Bedrock

-

Dalam daftar dropdown model bahasa, pilih model yang digunakan dengan JumpStart atau

sagemaker-endpointbedrockuntuk model yang dikelola oleh Amazon Bedrock. -

Parameternya berbeda berdasarkan apakah model Anda digunakan di SageMaker AI atau Amazon Bedrock.

-

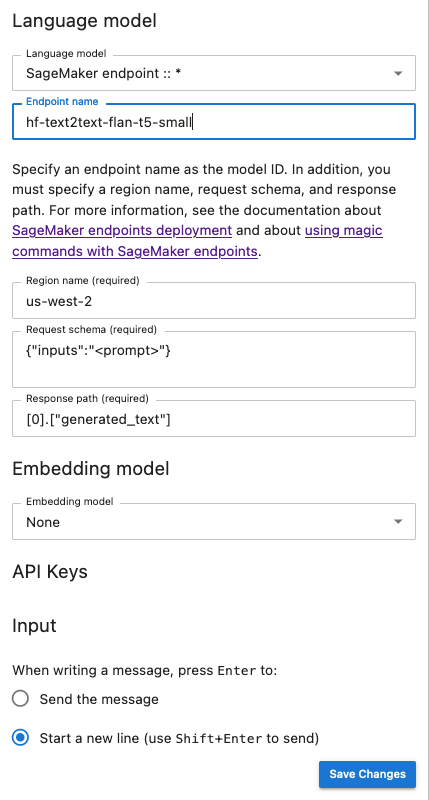

Untuk model yang digunakan dengan JumpStart:

-

Masukkan nama titik akhir Anda di nama Endpoint, dan kemudian Wilayah AWS di mana model Anda digunakan dalam nama Region. Untuk mengambil ARN dari SageMaker titik akhir AI, navigasikan https://console.aws.amazon.com/sagemaker/

ke dan kemudian pilih Inferensi dan Titik Akhir di menu kiri. -

Rekatkan JSON skema Permintaan yang disesuaikan dengan model Anda, dan jalur Respons yang sesuai untuk mengurai output model.

catatan

Anda dapat menemukan format permintaan dan respons dari berbagai model JumpStart pondasi di notebook contoh

berikut. Setiap notebook diberi nama sesuai model yang ditunjukkannya.

-

-

-

(Opsional) Pilih model penyematan yang dapat Anda akses. Model penyematan digunakan untuk menangkap informasi tambahan dari dokumen lokal, memungkinkan model pembuatan teks untuk menanggapi pertanyaan dalam konteks dokumen tersebut.

-

Pilih Simpan Perubahan dan arahkan ke ikon panah kiri (

) di sudut kiri atas panel kiri. Ini membuka UI obrolan AI Jupyter. Anda dapat mulai berinteraksi dengan model Anda.

) di sudut kiri atas panel kiri. Ini membuka UI obrolan AI Jupyter. Anda dapat mulai berinteraksi dengan model Anda.

-

-

Untuk model yang dihosting oleh penyedia pihak ketiga

-

Dalam daftar dropdown model bahasa, pilih ID penyedia Anda. Anda dapat menemukan detail masing-masing penyedia, termasuk ID mereka, di daftar penyedia model

AI Jupyter. -

(Opsional) Pilih model penyematan yang dapat Anda akses. Model penyematan digunakan untuk menangkap informasi tambahan dari dokumen lokal, memungkinkan model pembuatan teks untuk menanggapi pertanyaan dalam konteks dokumen tersebut.

-

Masukkan kunci API model Anda.

-

Pilih Simpan Perubahan dan arahkan ke ikon panah kiri (

) di sudut kiri atas panel kiri. Ini membuka UI obrolan AI Jupyter. Anda dapat mulai berinteraksi dengan model Anda.

) di sudut kiri atas panel kiri. Ini membuka UI obrolan AI Jupyter. Anda dapat mulai berinteraksi dengan model Anda.

-

-

Snapshot berikut adalah ilustrasi panel konfigurasi UI obrolan yang disetel untuk memanggil model FLAN-T5-Small yang disediakan oleh dan diterapkan di AI. JumpStart SageMaker

Berikan parameter model tambahan dan parameter khusus ke permintaan Anda

Model Anda mungkin memerlukan parameter tambahan, seperti atribut yang disesuaikan untuk persetujuan perjanjian pengguna atau penyesuaian parameter model lain seperti suhu atau panjang respons. Sebaiknya konfigurasi pengaturan ini sebagai opsi start up JupyterLab aplikasi Anda menggunakan Konfigurasi Siklus Hidup. Untuk informasi tentang cara membuat Konfigurasi Siklus Hidup dan melampirkannya ke domain Anda, atau ke profil pengguna dari konsol SageMaker AI

Gunakan skema JSON berikut untuk mengonfigurasi parameter tambahan Anda:

{

"AiExtension": {

"model_parameters": {

"<provider_id>:<model_id>": { Dictionary of model parameters which is unpacked and passed as-is to the provider.}

}

}

}

}Skrip berikut adalah contoh file konfigurasi JSON yang dapat Anda gunakan saat membuat JupyterLab aplikasi LCC untuk mengatur panjang maksimum model AI21 Labs Jurassic-2 yang digunakan di Amazon Bedrock. Meningkatkan panjang respons yang dihasilkan model dapat mencegah pemotongan sistematis respons model Anda.

#!/bin/bash

set -eux

mkdir -p /home/sagemaker-user/.jupyter

json='{"AiExtension": {"model_parameters": {"bedrock:ai21.j2-mid-v1": {"model_kwargs": {"maxTokens": 200}}}}}'

# equivalent to %%ai bedrock:ai21.j2-mid-v1 -m {"model_kwargs":{"maxTokens":200}}

# File path

file_path="/home/sagemaker-user/.jupyter/jupyter_jupyter_ai_config.json"

#jupyter --paths

# Write JSON to file

echo "$json" > "$file_path"

# Confirmation message

echo "JSON written to $file_path"

restart-jupyter-server

# Waiting for 30 seconds to make sure the Jupyter Server is up and running

sleep 30

Skrip berikut adalah contoh file konfigurasi JSON untuk membuat JupyterLab aplikasi LCC yang digunakan untuk mengatur parameter model tambahan untuk model Anthropic Claude yang digunakan di Amazon Bedrock.

#!/bin/bash

set -eux

mkdir -p /home/sagemaker-user/.jupyter

json='{"AiExtension": {"model_parameters": {"bedrock:anthropic.claude-v2":{"model_kwargs":{"temperature":0.1,"top_p":0.5,"top_k":25

0,"max_tokens_to_sample":2}}}}}'

# equivalent to %%ai bedrock:anthropic.claude-v2 -m {"model_kwargs":{"temperature":0.1,"top_p":0.5,"top_k":250,"max_tokens_to_sample":2000}}

# File path

file_path="/home/sagemaker-user/.jupyter/jupyter_jupyter_ai_config.json"

#jupyter --paths

# Write JSON to file

echo "$json" > "$file_path"

# Confirmation message

echo "JSON written to $file_path"

restart-jupyter-server

# Waiting for 30 seconds to make sure the Jupyter Server is up and running

sleep 30

Setelah Anda melampirkan LCC Anda ke domain Anda, atau profil pengguna, tambahkan LCC Anda ke ruang Anda saat meluncurkan aplikasi Anda JupyterLab . Untuk memastikan bahwa file konfigurasi Anda diperbarui oleh LCC, jalankan more ~/.jupyter/jupyter_jupyter_ai_config.json di terminal. Isi file harus sesuai dengan konten file JSON yang diteruskan ke LCC.

Konfigurasikan penyedia model Anda di buku catatan

Untuk memanggil model melalui Jupyter AI di dalam JupyterLab atau notebook Studio Classic menggunakan perintah dan ajaib %%ai%ai

-

Instal pustaka klien khusus untuk penyedia model Anda di lingkungan notebook Anda. Misalnya, saat menggunakan model OpenAI, Anda perlu menginstal pustaka

openaiklien. Anda dapat menemukan daftar pustaka klien yang diperlukan per penyedia di kolom paket Python dari daftar penyedia Model AI Jupyter.catatan

Untuk model yang di-host oleh AWS,

boto3sudah diinstal pada gambar Distribusi SageMaker AI yang digunakan oleh JupyterLab, atau gambar Ilmu Data apa pun yang digunakan dengan Studio Classic. -

-

Untuk model yang diselenggarakan oleh AWS

Pastikan peran eksekusi Anda memiliki izin untuk memanggil titik akhir SageMaker AI Anda untuk model yang disediakan oleh JumpStart atau bahwa Anda memiliki akses ke Amazon Bedrock.

-

Untuk model yang dihosting oleh penyedia pihak ketiga

Ekspor kunci API penyedia Anda di lingkungan notebook menggunakan variabel lingkungan. Anda dapat menggunakan perintah ajaib berikut. Ganti perintah

provider_API_keydalam dengan variabel lingkungan yang ditemukan di kolom variabel Lingkungan dari daftar penyedia Model AI Jupyter untuk penyediaAnda. %env provider_API_key=your_API_key

-